.

Benj Edwards / Strong The One

Mais de uma vez este ano, os especialistas em IA repetido um refrão familiar: “Por favor, diminua a velocidade.” As notícias de IA em 2022 foram rápidas e implacáveis; no momento em que você soubesse onde as coisas estavam atualmente na IA, um novo artigo ou descoberta tornaria esse entendimento obsoleto.

Em 2022, sem dúvida, atingimos o joelho da curva quando se trata de IA generativa que pode produzir trabalhos criativos compostos de texto, imagens, áudio e vídeo. Este ano, a IA de aprendizado profundo emergiu de uma década de pesquisa e começou a entrar em aplicações comerciais, permitindo que milhões de pessoas experimentassem a tecnologia pela primeira vez. As criações de IA inspiraram admiração, criaram controvérsias, provocaram crises existenciais e chamaram a atenção.

Aqui está uma retrospectiva das sete maiores notícias de IA do ano. Foi difícil escolher apenas sete, mas se não cortássemos em algum lugar, ainda estaríamos escrevendo sobre os eventos deste ano até 2023 e além.

Abril: DALL-E 2 sonhos em imagens

OpenAI

Em abril, a OpenAI anunciou o DALL-E 2, um modelo de síntese de imagem de aprendizado profundo que surpreendeu com sua capacidade aparentemente mágica de gerar imagens a partir de prompts de texto. Treinado em centenas de milhões de imagens extraídas da Internet, o DALL-E 2 sabia como fazer novas combinações de imagens graças a uma técnica chamada difusão latente.

O Twitter logo se encheu de imagens de astronautas a cavalo, ursinhos de pelúcia vagando pelo antigo Egito e outras obras quase fotorrealistas. Ouvimos falar do DALL-E pela última vez um ano antes, quando a versão 1 do modelo lutou para renderizar uma cadeira abacate de baixa resolução – de repente, a versão 2 estava ilustrando nossos sonhos mais loucos com resolução de 1024 × 1024.

A princípio, devido às preocupações com o uso indevido, o OpenAI permitiu apenas 200 testadores beta para usar o DALL-E 2. Os filtros de conteúdo bloquearam mensagens violentas e sexuais. Gradualmente, o OpenAI permitiu que mais de um milhão de pessoas participassem de um teste fechado, e o DALL-E 2 finalmente se tornou disponível para todos no final de setembro. Mas, a essa altura, outro concorrente no mundo da difusão latente havia surgido, como veremos a seguir.

Julho: engenheiro do Google acha que LaMDA é senciente

Getty Imagens | Washington Post

No início de julho, o Washington Post deu a notícia de que um engenheiro do Google chamado Blake Lemoine foi colocado em licença remunerada devido à sua crença de que o LaMDA (Modelo de linguagem para aplicativos de diálogo) do Google era senciente – e que merecia direitos iguais aos humanos.

Enquanto trabalhava como parte da organização de IA responsável do Google, Lemoine começou a conversar com LaMDA sobre religião e filosofia e acreditou ter visto a verdadeira inteligência por trás do texto. “Conheço uma pessoa quando falo com ela”, disse Lemoine ao Post. “Não importa se eles têm um cérebro feito de carne na cabeça. Ou se eles têm um bilhão de linhas de código. Eu falo com eles. E ouço o que eles têm a dizer, e é assim que decido o que é e não é uma pessoa.”

O Google respondeu que o LaMDA estava apenas dizendo a Lemoine o que ele queria ouvir e que o LaMDA não era, de fato, senciente. Como a ferramenta de geração de texto GPT-3, o LaMDA já havia sido treinado em milhões de livros e sites. Ele respondeu à entrada de Lemoine (um prompt, que inclui todo o texto da conversa) prevendo as palavras mais prováveis que deveriam seguir sem qualquer compreensão mais profunda.

Ao longo do caminho, Lemoine supostamente violou a política de confidencialidade do Google ao contar a outras pessoas sobre o trabalho de seu grupo. No final de julho, o Google demitiu Lemoine por violar as políticas de segurança de dados. Ele não foi a última pessoa em 2022 a se deixar levar pelo hype sobre o grande modelo de linguagem de uma IA, como veremos.

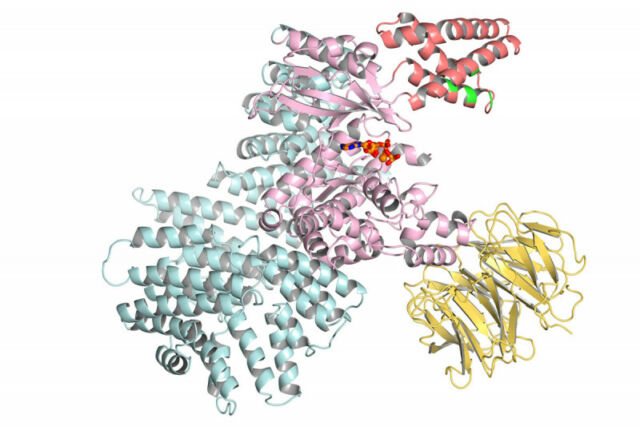

Julho: DeepMind AlphaFold prevê quase todas as estruturas de proteínas conhecidas

Em julho, a DeepMind anunciou que seu modelo AlphaFold AI havia previsto a forma de quase todas as proteínas conhecidas de quase todos os organismos da Terra com um genoma sequenciado. Anunciado originalmente no verão de 2021, o AlphaFold havia previsto anteriormente a forma de todas as proteínas humanas. Mas um ano depois, seu banco de dados de proteínas se expandiu para conter mais de 200 milhões de estruturas de proteínas.

A DeepMind disponibilizou essas estruturas protéicas previstas em um banco de dados público hospedado pelo Instituto Europeu de Bioinformática no Laboratório Europeu de Biologia Molecular (EMBL-EBI), permitindo que pesquisadores de todo o mundo possam acessá-las e usar os dados para pesquisas relacionadas à medicina e biologia Ciência.

As proteínas são blocos de construção básicos da vida, e conhecer suas formas pode ajudar os cientistas a controlá-las ou modificá-las. Isso é particularmente útil no desenvolvimento de novos medicamentos. “Quase todas as drogas que chegaram ao mercado nos últimos anos foram projetadas em parte por meio do conhecimento das estruturas das proteínas”, disse Janet Thornton, cientista sênior e diretora emérita da EMBL-EBI. Isso faz com que conhecer todos eles seja um grande negócio.

.