.

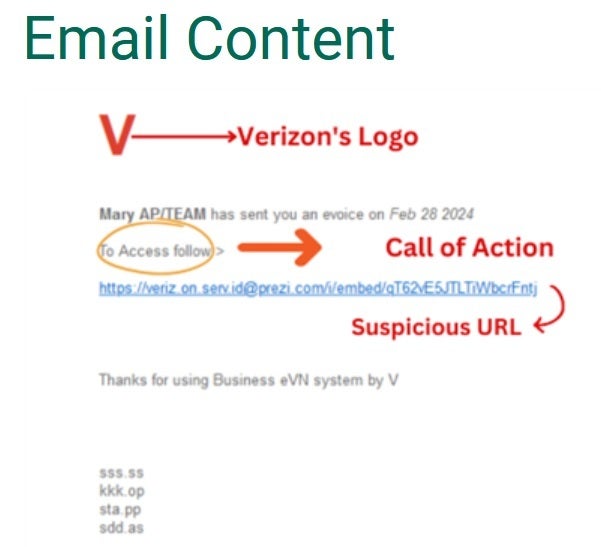

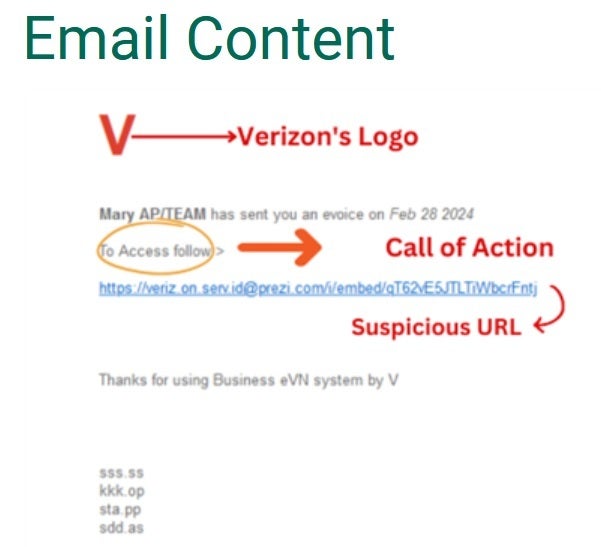

O relatório diz que os agentes maliciosos por trás desta campanha descobriram uma maneira de esses e-mails passarem por filtros de segurança e acabarem na caixa de entrada da vítima, em vez de na pasta de lixo eletrônico. O e-mail parece conter um link legítimo de Verizon para acessar sua fatura e solicita que você faça login em seu Verizon conta e clique em um link no e-mail. NÃO FAÇA ISSO!!! Você pode acabar entregando suas informações de login aos golpistas. Como observamos, isso pode fazer com que os malfeitores alterem o endereço da conta, solicitem um cartão SIM e roubem seu dinheiro.

Fortra mostra o que procurar em um e-mail falso enviado por um invasor como parte da campanha de phishing para clientes da Verizon

Clicar no link também pode permitir que os golpistas adicionem malware ao seu telefone ou computador. Se você receber um e-mail que pareça duvidoso, passe o mouse sobre o nome do remetente para ver a verdadeira origem da carta. Se você não tiver certeza se o e-mail é real, acesse a Internet para obter Verizonnúmero de telefone real e ligue para a empresa. Nunca, nunca, NUNCA clique em links encontrados em um e-mail ou texto não solicitado.

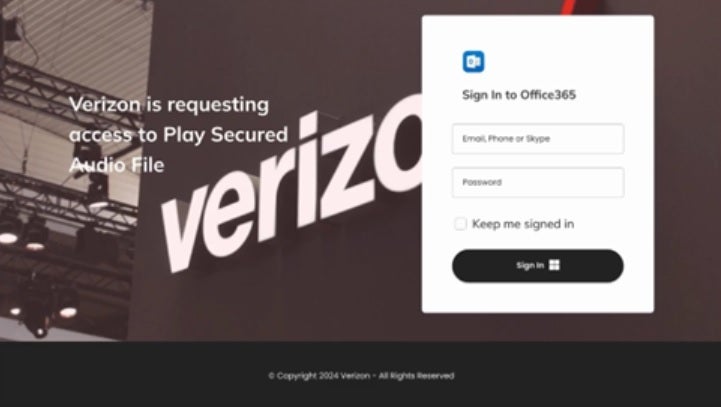

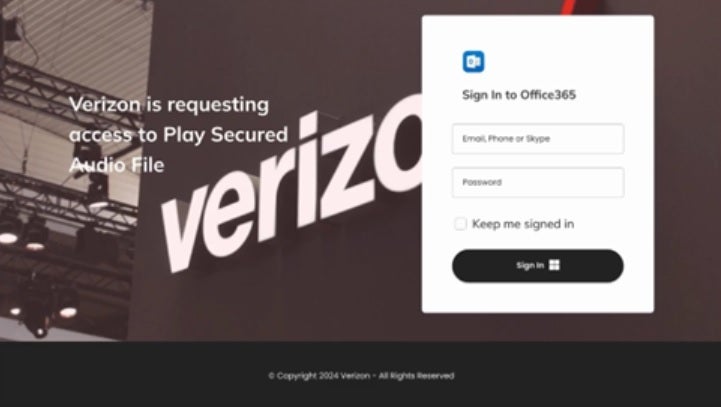

Fortra diz que o link também leva a uma farsa Verizon site que solicita que você faça login usando seu login do Office 365 para ouvir um Verizon Arquivo de áudio protegido. Esta é apenas uma tentativa de roubar seus dados de login do Office 365.

Clicar no link do e-mail falso o levará a uma página falsa da Verizon que solicita suas informações de login do Office 365

Verizon os assinantes precisam estar atentos a e-mails com as seguintes informações do remetente e muito mais:

- E-mail do remetente: member@surveymonkeyuser.com

- Endereço de resposta: ms365@verizservus.33mail.com

- Nome do remetente: ms365@veriservus.33mail.com via SurveyMonkey

- Data de inscrição: 18 de agosto de 2016

- Organização: SurveyMonkey Inc.

Uma maneira pela qual os golpistas tentam fazer com que você responda ao e-mail de phishing é fazendo parecer que algo ruim vai acontecer com você, a menos que você aja com urgência. Por exemplo, você pode receber um e-mail informando que perderá seu serviço sem fio, a menos que responda ao e-mail rapidamente. Recebi e-mails semelhantes no passado e os ignorei. Uma vez recebi um e-mail de Verizon que continha muitos erros ortográficos e gramaticais; essa é uma das bandeiras vermelhas que você deve procurar. Liguei Verizon usando o número de telefone que obtive e descobri que o e-mail realmente veio da operadora.

- Responda à mensagem de texto ou e-mail de qualquer forma

- Clique em qualquer link

- Abra todos os anexos

- Forneça quaisquer dados a quaisquer sites mencionados

.