.

O que você precisa saber

- A chefe de pesquisa do Google, Liz Reid, falou sobre os problemas que deram errado com as visões gerais de IA.

- Reid afirmou que o bot de IA acabou levando perguntas “absurdas” e “satíricas” um pouco a sério demais e acabou puxando a resposta de um troll da Internet para preencher o vazio.

- Seguindo em frente, Reid diz que o Google implementará um limite na quantidade de conteúdo “gerado pelo usuário” que sua IA obtém e sistemas de detecção para perguntas “absurdas”.

Após uma experiência verdadeiramente estranha com os resultados da visão geral de IA do Google na semana passada, a chefe de pesquisa da empresa, Liz Reid, está tentando esclarecer as coisas.

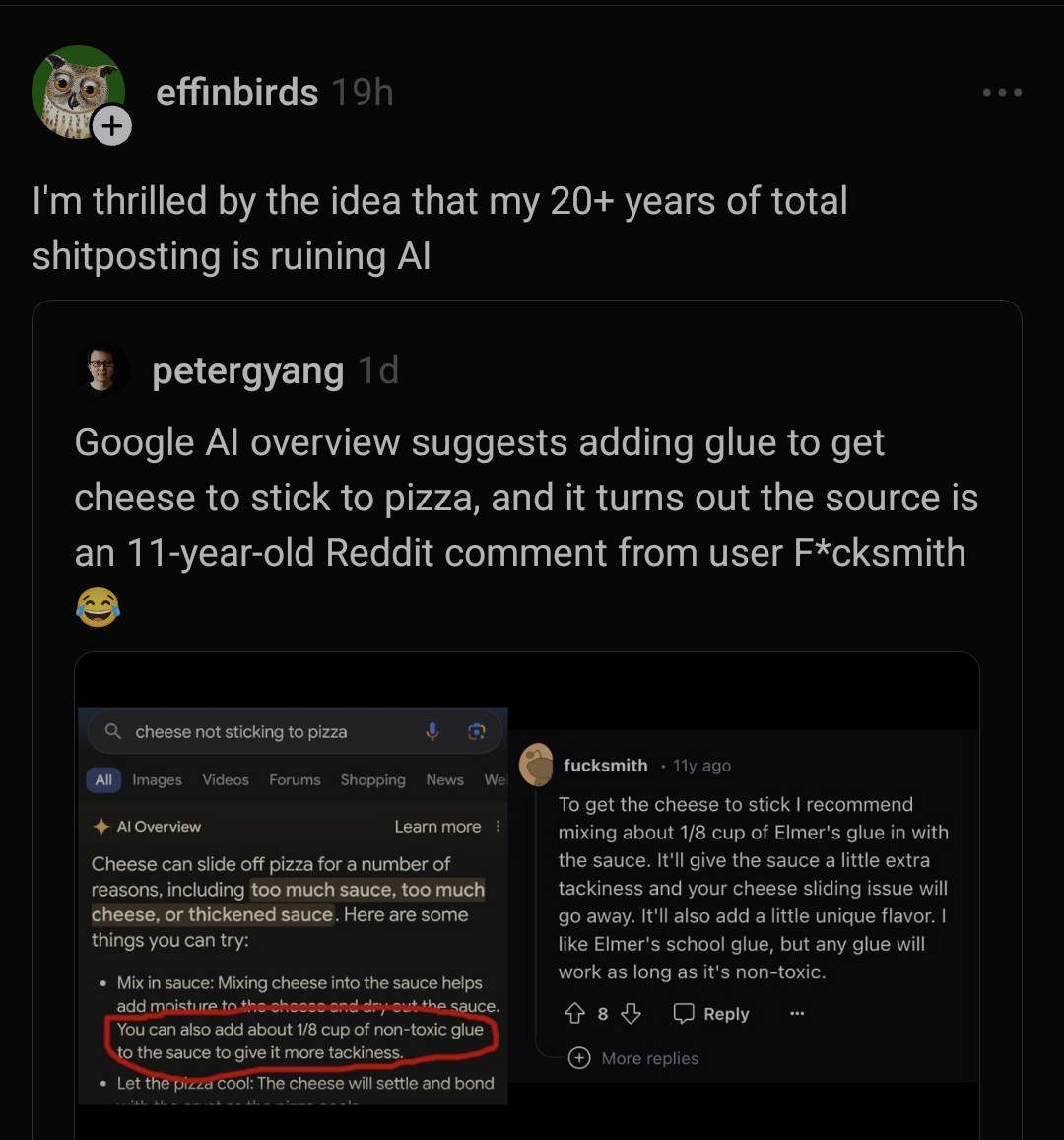

Na postagem de palavras-chave, Reid abordou as respostas estranhas e totalmente falsas que os resultados de pesquisa baseados em IA do Google forneciam aos usuários. Reid afirmou que, embora algumas das respostas estranhas que os usuários postaram nas redes sociais fossem capturas de tela falsas, outras realmente ocorreram. As respostas que as pessoas receberam foram atribuídas a “perguntas que as pessoas normalmente não fazem” – e aí reside o problema.

É por causa desse problema que o Google está voltando à cozinha e analisando com atenção como sua IA interpreta consultas “absurdas” e “satíricas”.

Reid usou um exemplo que apareceu em todos os lugares: “Quantas pedras devo comer?” Embora ninguém em sã consciência faria tal coisa, a IA realmente não sabe disso. Está simplesmente atendendo a uma consulta. O líder de pesquisa da empresa afirmou que, como não há muitos dados na Internet para “considerar seriamente” tal questão, ela se transformou em uma “lacuna de informação”.

Então, o que aconteceu é que a IA fez o possível para responder à pergunta e acabou puxando a resposta de um troll da internet para uma pergunta ultrajante. Reid acrescentou que a IA também extraiu informações sarcásticas de sites de fóruns (pense no Reddit) sobre o uso de cola para colar queijo em uma pizza.

O Google está trabalhando para corrigir suas visões gerais de IA em ampla escala, em vez de condensar os problemas em uma consulta única e aleatória. Reid informa que a empresa começou a construir melhores sistemas de detecção para essas consultas absurdas e “limitou a inclusão de conteúdo de sátira e humor”. Outro parâmetro inclui um limite de quanto conteúdo “gerado pelo usuário” a IA leva em consideração.

Para notícias importantes e de saúde, o Google permanece inflexível em não exibir visões gerais de IA para preservar os fatos e a autenticidade das informações disponíveis.

A IA da Pesquisa Google extrai informações de toda a Internet, o que pode ser um problema quando há trolls e shitposters por aí. Esperançosamente, com a empresa reiterando seu incentivo ao feedback dos usuários, esses problemas começarão lentamente a diminuir. Podemos não estar em um ponto em que seja completamente zero, mas, esperançosamente, comecem a circular mais fatos do que ficção.

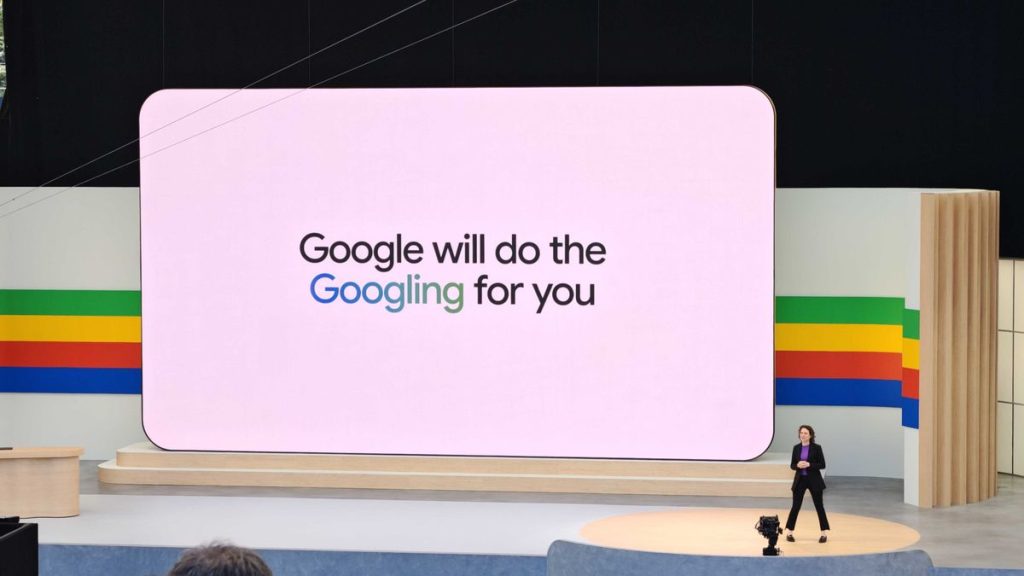

Além disso, esse problema com as visões gerais de IA surgiu algumas semanas depois que a empresa as lançou para todos. Durante o I/O 2024, o Google afirmou que suas visões gerais chegariam ao povo dos EUA em 14 de maio, junto com algumas configurações de ajuste de consulta. Normalmente, essas visões gerais são um trecho rápido, fornecendo ao usuário as informações mais importantes em um pequeno trecho.

Além disso, essas visões gerais de IA fornecem links para que os usuários possam fazer uma pequena verificação dos fatos para verificar a resposta do bot.

.