.

Aviso! Contém spoilers de Action Comics #1056!O herói Superboy acaba de encontrar uma nova aplicação incrível para uma de suas habilidades clássicas. Enquanto luta contra um enxame de robôs, Conner Kent descobre que um movimento poderoso pode torná-lo a arma secreta da Família Superman.

Em Action Comics #1056’s história “Ex Machina” de Phillip Kennedy Johnson, Rafa Sandoval e Max Raynor, a Família Superman está lutando contra um Superman Ciborgue dramaticamente atualizado. Embora a mente de Hank Henshaw esteja trancada na Zona Fantasma, ele tem um novo corpo poderoso e está controlando um exército de soldados Desfeitos, monstruosidades horríveis fundidas com a tecnologia Warworld. Superman e seus aliados lutam, mas as forças de Henshaw os estão desgastando.

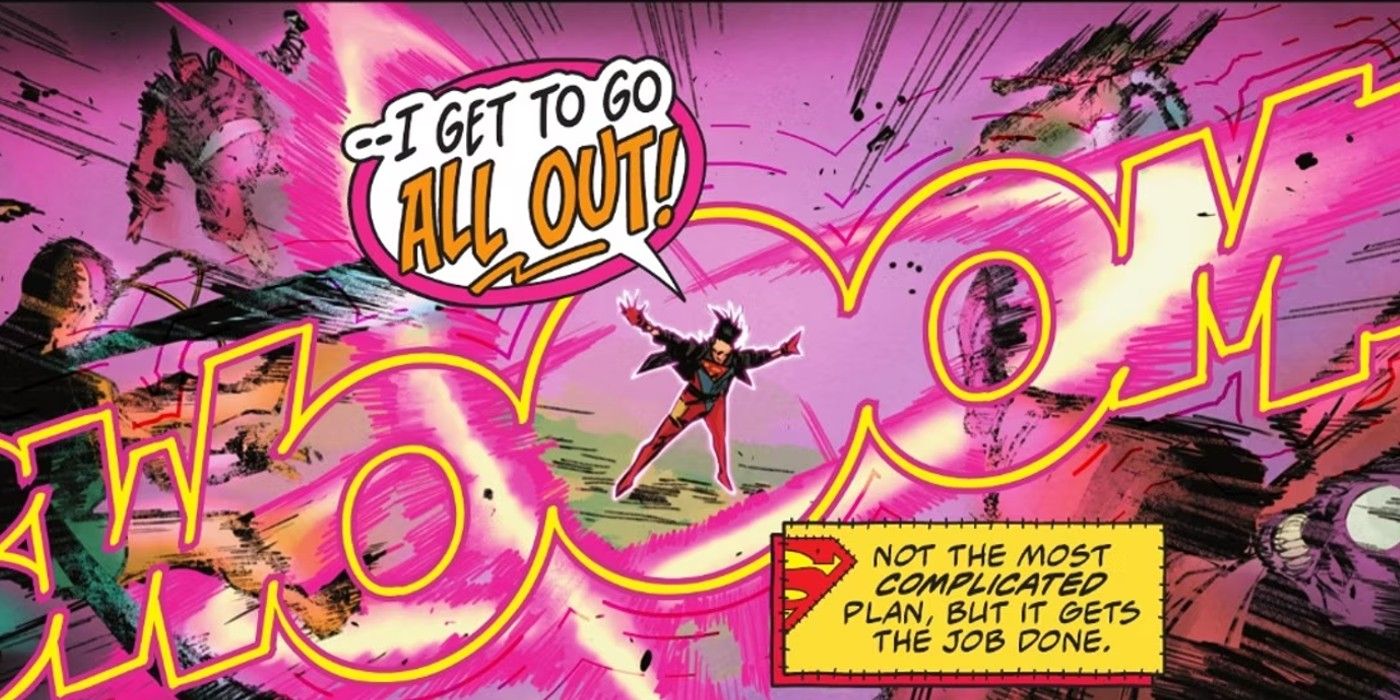

Superboy consulta o Erradicador, pedindo-lhe ajuda. Erradicador informa Conner que derrubar as construções do Superman Ciborgue um por um é ineficaz, mas Superboy poderia usar sua telecinese tátil para interromper os sinais elétricos de Henshaw, desligando suas forças em massa. Chocado por poder fazer isso, Conner segue a sugestão do Erradicador. Para a surpresa de todos, Superboy consegue colocar uma mossa nas forças do Cyborg Superman, dando a seus aliados tempo suficiente para partir para a ofensiva antes que Metallo desligue Henshaw, destruindo seu novo corpo em pedaços.

O maior poder do Superboy pode neutralizar sinais elétricos

Superboy é o clone meio kryptoniano e meio humano de Superman e Lex Luthor. Embora metade de seu DNA venha de um dos vilões mais nefastos vivos, Conner tem a mesma natureza gentil de Clark Kent. Ele também tem toda a gama de poderes do Homem de Aço, incluindo uma habilidade que é única para ele. Conner tem TK tátil, o que lhe permite manipular facilmente qualquer coisa que toca. Embora o Superboy tenha os mesmos poderes impressionantes do Superman ou da Supergirl, são as habilidades telecinéticas de Conner que o ajudam a se destacar da multidão.

Desde que ele apareceu pela primeira vez, Superboy empurrou o que seu TK tátil é capaz de fazer e encontrou novas maneiras de utilizá-lo. Mas ser capaz de desligar os sinais elétricos é uma atualização séria para a habilidade. O TK tátil era bom para combater as ameaças uma a uma, mas ser capaz de interromper os sinais é muito mais útil. Ele pode eliminar vários drones, robôs ou qualquer outra coisa que opere por meio de comandos. Conner pode não conseguir usar esse novo poder por muito tempo. Mas se ele continuar, Superboy pode se tornar o herói mais útil de toda a Família Superman.

Superboy poderia derrotar exércitos de robôs de uma só vez

Embora nem todo vilão que Superman ou sua família lutam use tecnologia que depende de sinais elétricos, há muitos que o fazem. Obviamente, Cyborg Superman é uma ameaça recorrente graças à sua capacidade de assumir qualquer tipo de tecnologia. E Brainiac tem enxames de drones que usa quando vai invadir planetas. Até mesmo Lex Luthor é conhecido por trazer máquinas poderosas para ajudá-lo a lutar contra o Superman. Todas essas ameaças e muito mais podem ser despachadas rapidamente pelo Superboy se ele realmente treinar essa nova habilidade dele. Pode não se aplicar a todas as situações ou vilões, mas certamente ajudará a equipe quando eles precisarem. Os fãs podem ver do superboy novo poder em Quadrinhos de Ação #1056à venda agora.

.