.

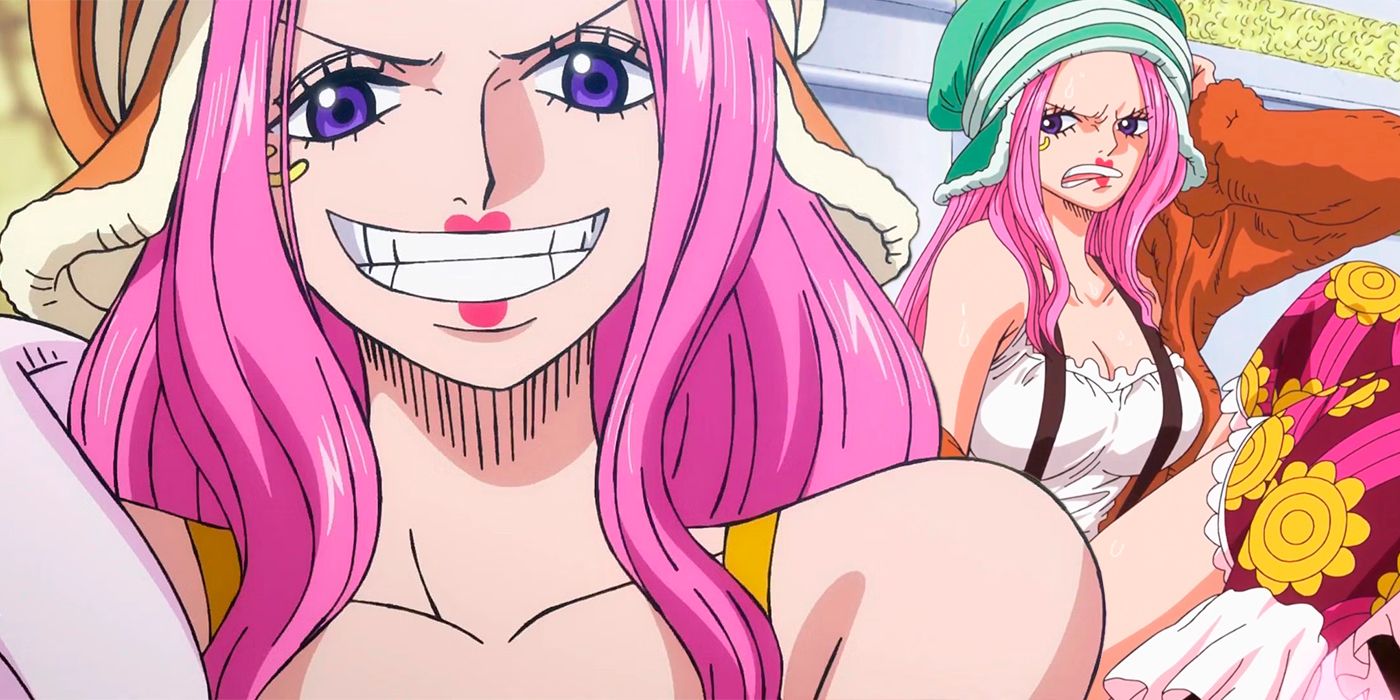

A nova habilidade de Jewelry Bonney no Capítulo 1072 pode finalmente ter mostrado o que a coloca em pé de igualdade com o resto da Pior Geração em termos de força.

O texto a seguir contém spoilers do capítulo 1072 de One Piece, “The Weight of Memory”, de Eiichiro Oda, Stephen Paul e Vanessa Satone, disponível em inglês na Viz Media.

Por um tempo, houve uma pergunta sobre o que torna a Jewelry Bonney tão forte por Uma pedaço padrões. Seu poder de envelhecer e rejuvenescer as pessoas certamente é algo para se ter cuidado, mas não parecia nada que a colocasse no mesmo nível do resto da Pior Geração. Se havia algo sobre essa garota que poderia lhe render uma recompensa de 320 milhões de Berries, não era óbvio.

Agora, no entanto, uma faceta adicional do poder de Bonney foi introduzida. É um aspecto de seu poder que ela pode usar para aumentar seu poder. É apenas temporário, mas dependendo de quão forte ela pode se tornar, pode ser o que lhe dá uma vantagem muito necessária em combate.

Como funciona o novo poder da Jewelry Bonney?

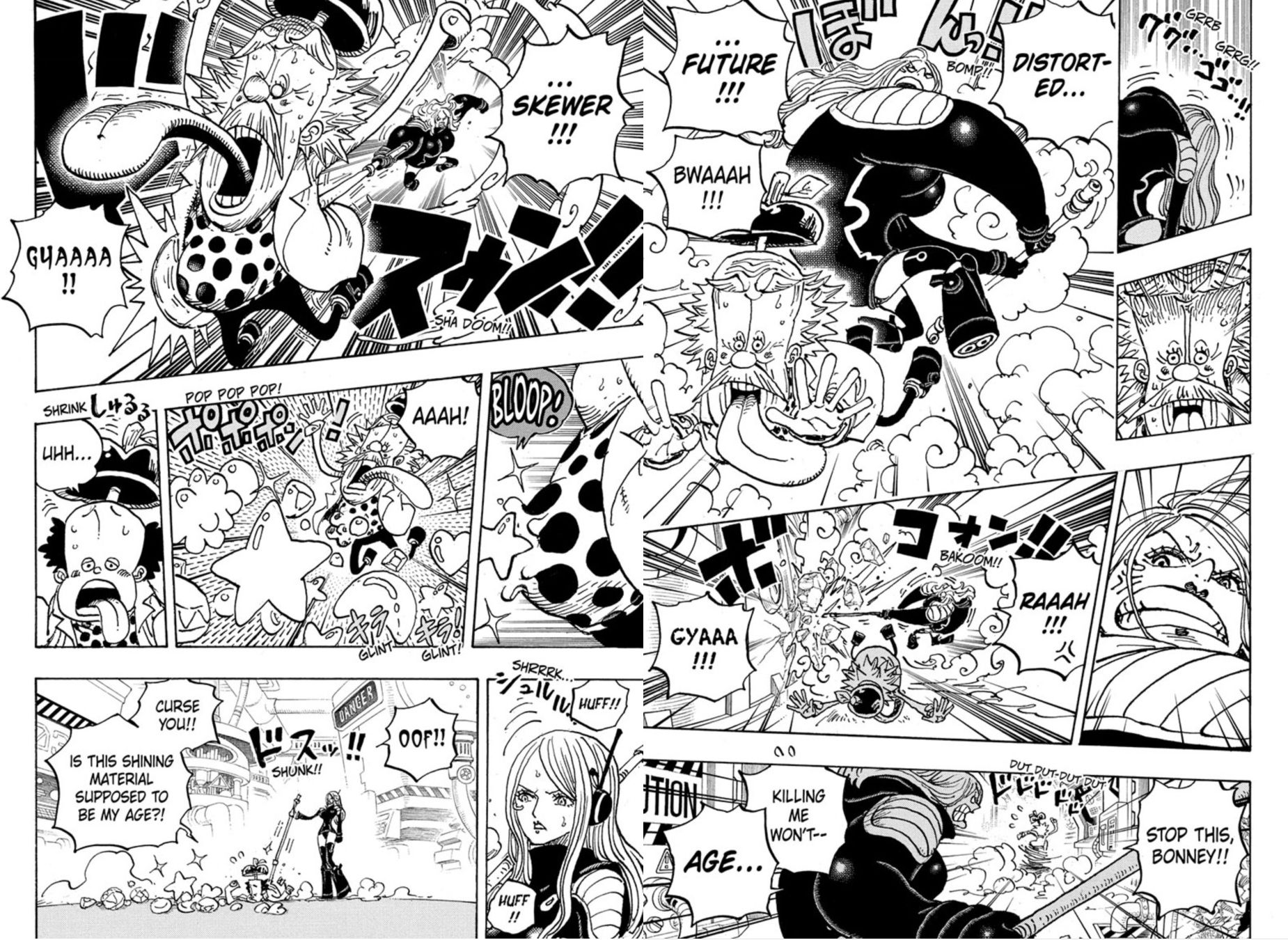

A nova técnica de Bonney foi apresentada no Capítulo 1072, “O Peso da Memória”. Ao envelhecer em um “Futuro Distorcido”, ela pode dar a seu corpo características que normalmente seriam o resultado de certas experiências. A “distorção” implica que o alvo poderia acabam em um determinado estado, dependendo de suas escolhas de vida.

Essa técnica foi mencionada no Capítulo 1064, “Egghead Labophase”. Aqui, Bonney conseguiu envelhecer Monkey D. Luffy em uma versão possível de seu eu de 70 anos. Na época, parecia uma simples referência à tendência de Eiichiro Oda de traçar futuros possíveis no Uma pedaço SBS, mas agora é evidente que há um significado maior por trás disso.

Quando Bonney usou essa técnica em si mesma, ela envelheceu em um futuro em que era ridiculamente forte. Isso provavelmente representa um futuro em que ela treinou seu corpo para atingir níveis excessivos de força física. Pode até representar uma linha do tempo em que ela está passando por esse tipo de treinamento desde criança. No entanto, ela conseguiu esse poder, é muito maior do que qualquer coisa que ela tenha na linha do tempo atual.

O que torna esta técnica tão potencialmente devastadora é a natureza da Uma pedaço. A série é um shonen de batalha tradicional, então os personagens podem continuar crescendo exponencialmente poderosos, desde que treinem o suficiente. Isso significa que, em teoria, Bonney poderia envelhecer em uma linha do tempo em que treinou ainda mais e ficou ainda mais forte. Mesmo que Bonney envelheça até o que deveria ser seu auge físico, a quantidade de poder que isso pode dar a ela pode ser insondável.

O novo poder de Bonney a torna tão forte quanto os outros membros da pior geração?

Claro, o verdadeiro potencial do futuro distorcido de Bonney ainda é um pouco difícil de prever. A partir do Capítulo 1072, apenas uma breve demonstração disso está presente na série e não tornou Bonney particularmente poderoso. Além disso, apenas um breve uso era suficiente para desgastá-la. Ao mesmo tempo, porém, isso pode ser apenas a ponta do iceberg justamente por ser um exemplo tão breve.

No mínimo, esse aumento de força explicaria o que a coloca no mesmo nível de alguns de seus contemporâneos da pior geração. Na parte inferior, isso pode colocá-la no mesmo nível de nomes como Basil Hawkins ou Scratchmen Apoo. Dependendo dos limites superiores de seu potencial, ela pode até chegar perto de nomes como Capone Bege ou Urouge. Qualquer coisa acima do nível de Killer ou Zoro pode ser um exagero, mas, novamente, o treinamento shonen pode percorrer um longo caminho. No que diz respeito à fisicalidade, o futuro de Bonney é literalmente o que ela faz dele.

.