.

Com apenas mais um episódio restante para Dragon Ball Daimatodos teremos com certeza na próxima semana se o anime está ou não no mesmo cânone Dragon Ball Super – Mas as coisas francamente não estão boas para Dbs. Agora que Goku pode aparentemente se tornar Super Saiyan 4 à vontade sem a ajuda de Neva, a única coisa que pode impedir Dragon Ball Super Por ser reexplicado, é um final policial que apaga as memórias do elenco principal do reino demoníaco. A maioria dos fãs espera que isso aconteça há semanas. Afinal, é a única maneira de reconciliar erros de continuidade e formar deprodências. Mas o problema é que um limpeza de mente não pode reconciliar o Super Saiyan 3 Vegeta.

Em Dragon Ball Daima Episódio 12, “VERDADEIRA FORÇA”, Bulma diz a Goku que Vegeta “está treinando sozinho há tanto tempo” quando Goku pergunta como ele desbloqueou o formulário. Esta linha sugere fortemente vegeta já desbloqueada Super Saiyan 3 antes dos eventos de Dragon Ball Daima â € não desencadeando -o em sua luta contra o número dois de Tamagami. Dragon Ball Não é estranho a linhas descartáveis que são prontamente esquecidas (lembre-se de quando o feijão senzu costumava alimentar o seu por dez dias?), Então seria um problema desde que Vegeta nunca virou o Super Saiyan 3 novamente-especialmente porque SSJ3 conhecem problemas de resistência.

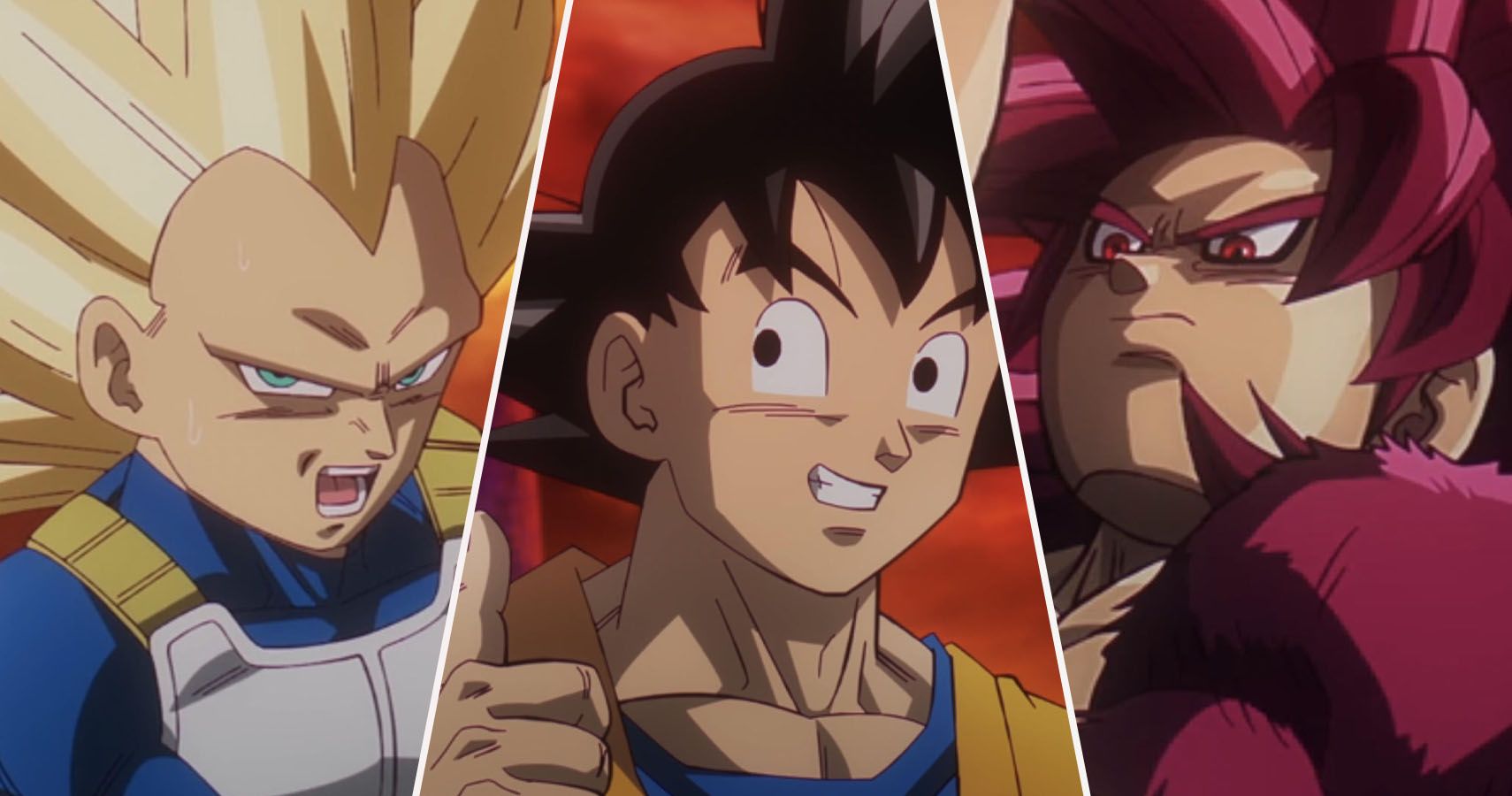

Obviamente, não foi isso que aconteceu. AS Dragon Ball Daima Episódio 19, “Betrayal”, Vegeta é um adulto novamente e volta a usar o Super Saiyan 3 como sua forma mais forte. Embora Goku faça nota da resistência em declínio de SSJ3 Vegeta, ele ainda está mais do que forte o suficiente para causar sérios danos ao rei Gomah e teria o matado se o terceiro olho não interfitasse. Embora seja possível que o argumento de Vegeta desta luta seja que o Super Saiyan 3 seja arriscado demais para usar – explicando assim por que ele não o usou contra o Beerus em Dragon Ball Z: Battle of Gods â € ”Isso não faz sentido com o que é mostrado na tela e flagradavelmente conradia o peso emocional de” esse é meu bulma! ” momento.

Relacionado

Dragon Ball Daima Episódio 19 cresce como Super Saiyan 3 Vegeta e Super Saiyan 4 Goku Redefine o anime

O penúltimo episódio de Dragon Ball Daima restaura o status quo em um ataque glorioso e cheio de ação, enquanto Goku e Vegeta se esforçam ao Gomah.

1

Vegeta teria virado Super Saiyan 3 contra Beerus se ele pudesse ter

Bulma se machucando desperta todo o poder latente de Vegeta

Olha, simplesmente não há como contornar o fato de que, se Vegeta pudesse virar o Super Saiyan 3, ele logicamente teria quando estava atacando Beerus. No momento em que Beerus dá um tapa em Bulma, vegeta se encaixa em todos de seu poder, canalizando essa força bruta para uma versão aprimorada do Super Saiyan 2 ainda mais forte que o Super Saiyan 3 Goku. Como o mestre Roshi é frequentemente usado como substituto para Akira Toriyama no mangá original para transmitir Informaton (como quebrar a quarta parede para nos contar que a história não estará terminando no 23º Tenkaichi Budokau ou Cell Games), o fato de que Roshi é o de Roshi, um para apontar o quanto Vegeta cresceu Dragon BallA maneira de informar ao público que esse é o verdadeiro negócio: Vegeta realmente superou Goku.

Relacionado

Dragon Ball finalmente permite que o vegeta adulto vire o Super Saiyan 3 pela primeira vez em Canon

Dragon Ball Daima Episódio 19 Finalmente deixa Vegeta se tornar um Super Saiyan 3 em sua forma adulta enquanto ele enfrenta o rei Gomah e seu terceiro olho do mal.

2

Contextualmente, a cena e o louvor de Roshi só fazem sentido se o Super Saiyan 2 for a forma mais forte de Vegeta. O fato de SSJ2 Vegeta superar o SSJ3 Goku – fazendo Beerus sangrar – faz parte do que torna o momento tão impressionante. Da mesma forma, isso deve ser uma batida emocionalmente carregada para Vegeta. Ele não está pensando claramente, nem tem o luxo de criar estratégias. Ele está simplesmente entrando em ação com seus movimentos mais fortes, em sua forma mais forte, para proteger a mulher que mais ama. Vegeta segurando o Super Saiyan 3 neste momento, intencional ou não, não apenas não faz sentido, como está fora de caráter – especialmente depois do que Dragon Ball Daima nos mostra.

Super Saiyan 3 Vegeta manipula tanto o rei Gomah, não faz sentido que ele lute contra Beerus como um Super Saiyan 2

A única razão pela qual Vegeta não se volta para o Super Saiyan 3 é porque ele literalmente não pode

Os maiores detalhes que matam a idéia de que Vegeta retribuiu o Super Saiyan 3 porque é menos eficaz do que o Super Saiyan 2 é simplesmente o fato de que, de acordo com Dragon Ball Daimaé a própria lógica, é Melhor usar apenas SSJ3. Super Saiyan 3 Vegeta coloca um incrível Desempenho contra o terceiro olho Gomah, superando o Super Saiyan 4 Goku do episódio 18 em quase todos os aspectos. Em questão de minutos, o SSJ3 Vegeta consegue colocar Gomah nas cordas e tecnicamente “mata” com um flash final super carregado.

Relacionado

Dragon Ball Daima Episódio 20 cria a batalha final do anime (e Fusion Fusion?)

Dragon Ball Daima está quase no fim, mas o anime final do falecido Akira Toriyama está saindo com um estrondo para sua batalha final entre Goku e Gomah.

Super Saiyan 3 Vegeta, em última análise, não tem energia suficiente para combater o Gomah revivido, mas ele teria vencido contra qualquer outro oponente. Da mesma forma, basta comparar ssj3 vegeta vs gomah com ssj3 goku vs kid buu do final de Dragon Ball Z.. Super Saiyan 3 Goku nunca ganha as vantagens e mais ou menos fica sem Ki imediatamente no mangá. Super Saiyan 3 Vegeta tem um controle de resistência muito maior que Goku, apesar de desbloquear a forma como um mortal, o que significa vegeta lidado com distante maior tensão física do que Goku já fez.

Dragon Ball Z: Battle of Gods foi obviamente escrito antes Dragon Ball Daima e Super Saiyan 3 se tornou uma transformação canônica para Vegeta, mas isso apenas o coloca Daima Para garantir que o anime não esteja quebrando a continuidade. Como está, é difícil imaginar qualquer cenário em que Super Saiyan 3 Vegeta e Batalha dos deuses são o cânone onde Vegeta não parece um tolo completo no último. Se Dragon Ball Daima tenta justificar as coisas alegando que Vegeta não gosta do Super Saiyan 3, apenas subestimará sua luta com Beerus.

Dragon Ball Super está cheio de orifícios da trama se Dragon Ball Daima for Canon

Dragon Ball precisa tomar uma decisão difícil

Se Dragon Ball Daima é canon para Dragon Ball SuperVegeta não virando o Super Saiyan 3 contra o Beerus é um enredo – não há duas perguntas sobre isso. Mas, francamente, isso pode muito bem ser o ao menos de Dragon BallOs problemas agora. Dragon Ball Daima não tem escassez de momentos, linhas e conceitos que contradizem completamente a tradição ou o diálogo de Dragon Ball Super. Em Dragon Ball Super O capítulo 2, Goku, diz a Beerus que Super Saiyan 3 é sua forma mais forte e que “não há mais transformações depois disso”. Isso não é algo que Goku diria se ele tivesse virado o Super Saiyan 4 antes (limpeza de mente pendente, lembre-se).

O Dragon Ball A franquia basicamente tem duas opções avançando. O primeiro é apenas manter os caminhões à frente, erros de continuidade e tudo. Ambos Dragon Ball Super e Dragon Ball Daima São Canon – só precisamos aceitar que haverá soluços e contradições narrativas com base no fato de terem sido escritos anos de diferença. A outra opção seria para Dragon Ball Para se ramificar em um multiverso adequado com várias continuidades decorrentes do fim da saga Majin Buu: o mangá original, Dragon Ball GTAssim, Dragon Ball Supere agora Dragon Ball Daima. Isso permite que todos tenham seu bolo e comem também sem estragar anos de conhecimento. Também permite ambos Dragon Ball Super e Dragon Ball Daima Continuar contando histórias desproporcionadas um pelo outro.

Um multiverso genuíno também não estaria fora de questão para a série, pois ambos Dragon Ball Xenoverse e Dragon Ball Heroes Faça o uso pesado do conceito para suas próprias histórias – a última misturando regularmente e combinando personagens diferentes de DbzAssim, Gte Super. Só o tempo dirá em qual direção Dragon Ball vai entrar, mas uma coisa é certa: Dragon Ball Super terá mais buracos do que os baús de Goku & Raditz se Dragon Ball Daima é Canon.

Dragon Ball Daima

- Data de lançamento

-

11 de outubro de 2024

- Escritores

-

Akira Toriyama

- Franquia (s)

-

Dragon Ball

Devido a uma conspiração, Goku e amigos são transformados em crianças. Eles pretendem viajar para um novo mundo misterioso para desfazer essa mudança

.

Seu comentário não foi salvo