.

Batman teve muitos aliados em seus anos lutando contra o crime, mas parece que Bruce acabou arruinando a vida de seu aliado mais antigo, Alfred Pennyworth.

Aviso! Contém spoilers para Batman #132!Alfred Pennyworth é de longe um dos membros mais leais e confiáveis da Bat-Família, ele tem servido homem Morcego por quase tanto tempo quanto Bruce usou o capuz, o que torna ainda mais trágico que Batman seja a razão secreta pela qual Alfred nunca poderia ser feliz.

Embora quase todos os membros da Bat-Família tenham partido em um ponto ou outro, um membro permaneceu uma constante: Alfred Pennyworth. Não importa o quão ruim as coisas ficassem entre ele e Bruce, ele raramente abandonava o Batman. Isso torna tudo ainda mais trágico quando é revelado em Batman #132 por Chip Zdarsky e Mike Hawthorne que a maior coisa que impede Alfred de ser feliz é o próprio Batman. Batman foi recentemente transportado para um universo onde Bruce Wayne está morto e Batman nunca existiu, o que parece ter permitido a Alfred atuar em um antigo romance no qual ele nunca foi realmente capaz de atuar no Universo DC principal.

A cruzada de Batman arruína a vida das pessoas ao seu redor

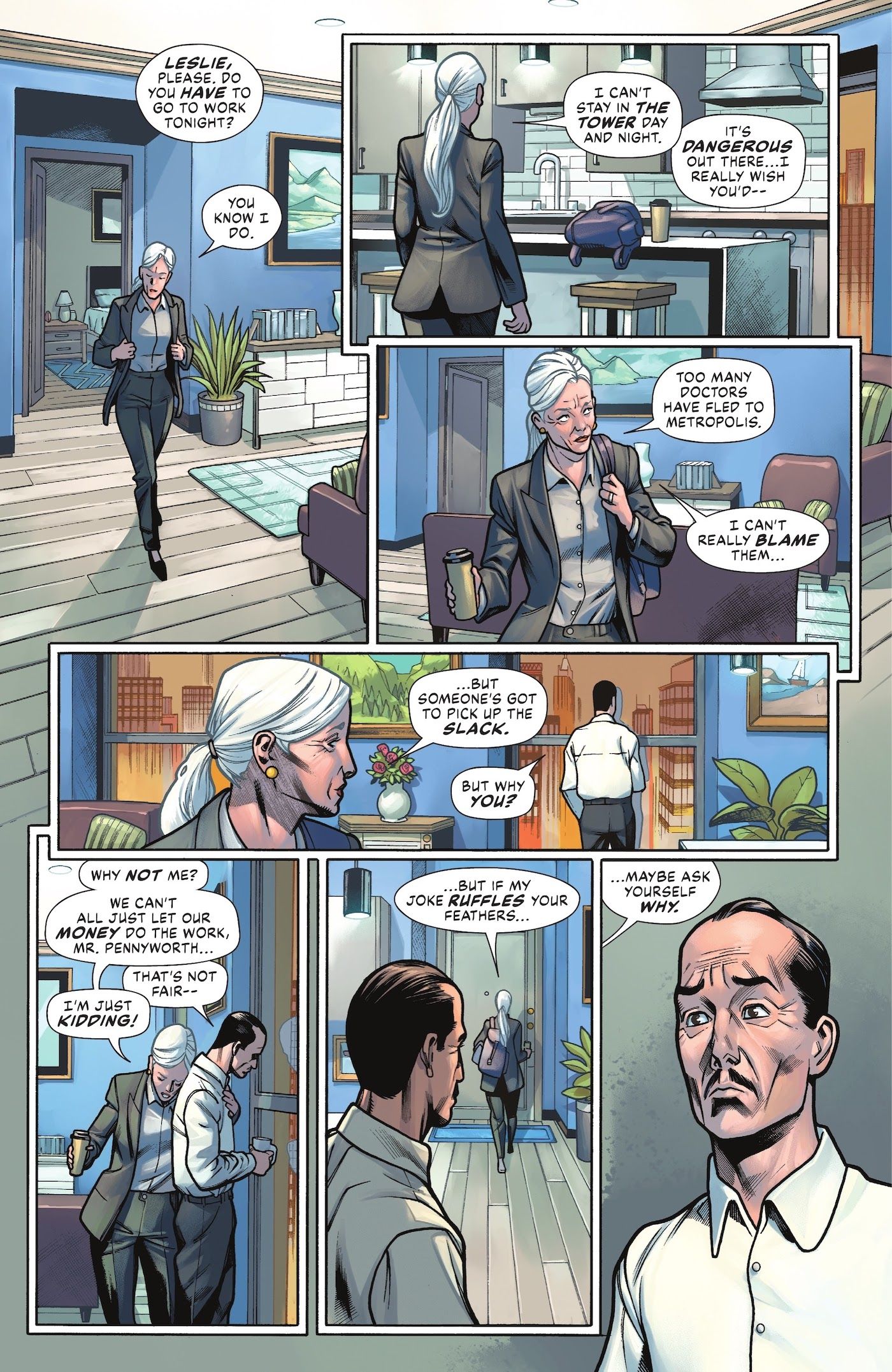

Alfred dedicou sua vida à cruzada de Batman contra o crime e, embora isso certamente o tornasse um dos aliados mais antigos e valiosos de Batman, realmente não lhe deixava muito tempo para uma vida social. A única família que Alfred realmente tem fora de Bruce é uma filha que ele gerou antes de vir trabalhar para os Waynes. Depois que começou a trabalhar, ele realmente não tinha tempo para nenhum amigo ou interesse amoroso. Quando Bruce Wayne partiu para viajar pelo mundo, Alfred iniciou um romance com Leslie Thompkins, mas quando Bruce voltou, Alfred teve que terminar para ajudar Batman. Isso é trágico porque Alfred e Leslie fez formam um bom casal.

Neste novo universo, Alfred e Leslie Thompkins parecem estar morando em um apartamento muito chique, acima do resto de Gotham City, e eles parecem ter um casamento feliz. Isso parece ser possível apenas porque Bruce Wayne está morto e Batman nunca existiu. Bruce neste universo doou toda a sua fortuna e se tornou um assistente social, antes de aparentemente ser assassinado. Isso permitiu que Alfred vivesse sua vida, mas no universo principal, Alfred era totalmente devotado a Bruce e, por causa disso, a morte de Alfred era inevitável. Alfred morreu no Universo DC principal nas mãos de Bane, um vilão que só estava lá por causa do Batman. Esta é a grande tragédia da cruzada de Batman: leva todos em sua vida para apoiá-la e isso muitas vezes não os deixa espaço para viver suas próprias vidas. Dick Grayson deixou o Batman para começar sua própria vida como Asa Noturna, porque sabia que, se não o fizesse, seu futuro seria dominado pela cruzada de Bruce, e ele provavelmente teria que assumir o papel de Batman.

Embora a guerra de Batman contra o crime tenha beneficiado inegavelmente o povo de Gotham City, também teve um impacto negativo nas pessoas que realmente precisam ajudá-lo a lutar nessa guerra. É por isso que tão bom aliado quanto Alfredo foi, ele nunca realmente conseguiu viver sua vida por causa de homem Morcego.

Batman #132 já está à venda na DC Comics!

.