.

A comunicação consciente é o ato de estar presente e intencional em todas as formas de comunicação, incluindo falar e ouvir. Essa abordagem envolve estar ciente de pensamentos, sentimentos e sensações físicas em cada momento e usar essa consciência para se comunicar de maneira compassiva e sem julgamento.

Ao praticar a comunicação consciente, você pode melhorar seus relacionamentos com os outros, reduzir o estresse e os conflitos e aumentar seu bem-estar geral. De aplicativos de atenção plena e dicas de etiqueta na Internet a cursos de comunicação online, você pode usar a tecnologia para praticar essa importante habilidade. Então, vamos nos aprofundar em como você pode se tornar um comunicador mais consciente.

Habilidades que você precisa para ser um comunicador consciente

A primeira e mais fácil coisa que você pode fazer para estar mais atento ao se comunicar é começar uma prática de meditação regular (ou seja, diária). Você pode fazer isso usando um dos vários aplicativos de meditação e atenção plena, com opções populares como Waking Up, Calm e Insight Timer. Cada aplicativo tem seu próprio sabor e variedade de recursos que podem ajudar a melhorar suas habilidades de comunicação de várias maneiras:

- Melhore a escuta ativa: Ao desenvolver a concentração por meio da meditação, você pode ter um estado mental mais concentrado e presente que pode torná-lo um ouvinte melhor. Quando você está atento durante uma conversa, é menos provável que você se distraia e mais propenso a dar à pessoa com quem está falando toda a sua atenção.

- Reduza o estresse e a ansiedade: A comunicação pode ser estressante, especialmente quando envolve conflitos ou conversas difíceis. A meditação pode ajudá-lo a se sentir mais calmo e centrado nessas situações. Ele pode equipá-lo melhor para lidar com cenários de comunicação desafiadores ou emocionais.

- Aumentar a empatia: As práticas de atenção plena podem ajudá-lo a desenvolver empatia e inteligência emocional, que são componentes essenciais de uma comunicação eficaz. A meditação também pode ajudá-lo a entender melhor as perspectivas dos outros e a se comunicar com maior sensibilidade e compaixão.

- Melhorar a confiança: A confiança é um componente chave da comunicação eficaz. A meditação pode ajudá-lo a desenvolver uma maior autoconsciência, permitindo que você identifique e resolva seus próprios pontos fortes e fracos de comunicação.

Tente usar um aplicativo de atenção plena para se concentrar em seus pensamentos, aprender a entender como você reage a diferentes situações e se preparar para as próximas conversas.

Recursos de aprendizagem digital

Existem vários recursos digitais que você pode acessar para ajudar a reforçar seu conjunto de habilidades de comunicação consciente.

Comunicações Conscientes

O canal Mindful Communications no YouTube é dedicado a ajudá-lo a melhorar suas habilidades de comunicação por meio da atenção plena. É um ótimo recurso para quem quer desenvolver suas habilidades de comunicação consciente, com episódios completos dos podcasts Mindful Communications, bem como dicas rápidas sobre como ser um comunicador melhor e mais consciente. Comece com estes vídeos:

- Como Falar Autenticamente (YouTube)

- Como fazer um grande elogio (YouTube)

- Como fazer os outros entenderem o que você está dizendo (YouTube)

Diga o que você quer dizer livro e áudio digital

O livro Say What You Mean de Oren Jay Sofer e o áudio guiado complementar (disponível gratuitamente no site da Sofer) são projetados para ajudá-lo a se tornar um comunicador mais confiante, assertivo e eficaz. Com base nos princípios da comunicação não violenta, o livro e a série de áudio cobrem uma variedade de tópicos, incluindo como se expressar com clareza, como administrar conflitos e como se comunicar com empatia.

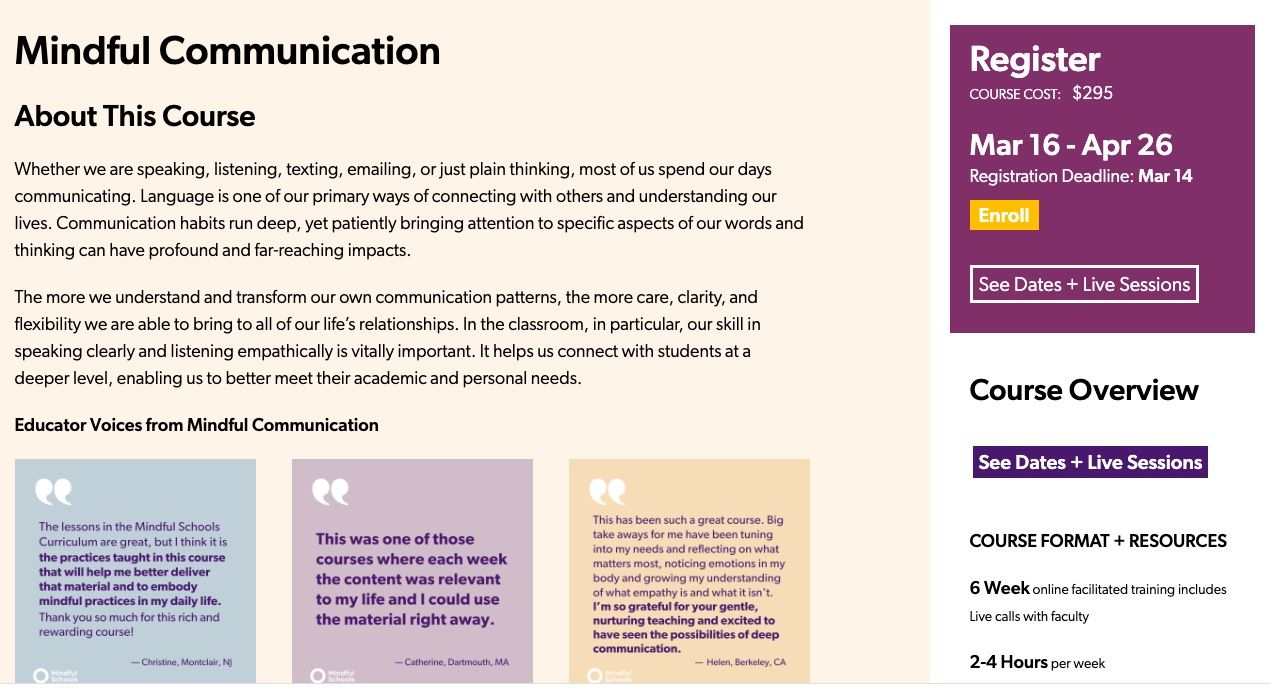

Programa On-line Comunicação Consciente para Professores

Mindful Communication for Teachers é um recurso digital desenvolvido especificamente para professores. Ele se concentra em ajudar os educadores a melhorar suas habilidades de comunicação na sala de aula. O programa abrange tópicos como escuta ativa, feedback eficaz e resolução de conflitos. Ele também fornece aos professores estratégias práticas que eles podem usar para criar um ambiente de aprendizado mais consciente e solidário.

O programa online, que é oferecido várias vezes ao longo do ano, tem 6 semanas de duração. Inclui duas chamadas ao vivo com professores, vídeos com instruções e recursos multimídia como áudio guiado e atividades. Há também um fórum online onde você pode discutir o conteúdo do curso para solidificar seu aprendizado.

Podcasts sobre comunicação consciente

Os podcasts são um excelente método para consumir conteúdo educacional (e divertido), e existem vários podcasts que você deve conferir para obter orientação sobre comunicação consciente.

Por exemplo, no podcast Ten Percent Happier apresentado por Dan Harris, você pode encontrar conversas animadas entre o anfitrião e convidados como Dan Clurman e Mudita Nisker, que discutem como falar com clareza, calma e sem alienar as pessoas.

Ao mesmo tempo, no podcast The Leadership Gap, você pode aprender sobre tópicos como escuta profunda e inteligência emocional com dois podcasters interessados em ajudá-lo a se tornar um líder melhor no local de trabalho.

Dicas para ser um comunicador mais consciente

Aqui estão algumas dicas para se tornar um comunicador mais atento e usar a tecnologia a seu favor, em vez de se distrair com ela.

- Desligue o telefone durante as conversas: é muito fácil se distrair com seus dispositivos quando você está tentando conversar com alguém. Tente deixar o telefone de lado e dar toda a atenção à pessoa com quem você está falando. Isso não apenas ajudará você a ser mais consciente em sua comunicação, mas também mostrará à outra pessoa que você valoriza o tempo dela e o que ela tem a dizer.

- Pratique a escuta ativa: Quer esteja conversando on-line ou pessoalmente, ouça o que eles têm a dizer, em vez de apenas pensar no que você vai dizer a seguir. Faça perguntas, mostre interesse e dê feedback à pessoa com quem está falando. Esse tipo de escuta ativa o ajudará a estar mais presente e atento em sua comunicação.

- Faça pausas na tecnologia: a tecnologia pode ser esmagadora e é importante fazer pausas para recarregar as energias e ficar atento. Tente reservar algum tempo todos os dias para se desconectar da tecnologia e se concentrar em ser mais consciente. Isso pode ajudá-lo a estar mais presente e intencional em sua comunicação ao usar a tecnologia.

Comece a praticar a comunicação consciente

Aprender a comunicação consciente pode ser uma ferramenta valiosa para o crescimento pessoal e para melhorar o relacionamento com os outros. Esteja você procurando um curso individualizado, exercícios guiados de atenção plena ou recursos direcionados para educadores, não faltam recursos digitais que podem ajudá-lo a se tornar um comunicador mais eficaz e consciente.

.