.

Nicolas Cage revela seu motivo convincente para querer fazer um filme solo do Drácula após sua atuação coadjuvante no próximo Renfield.

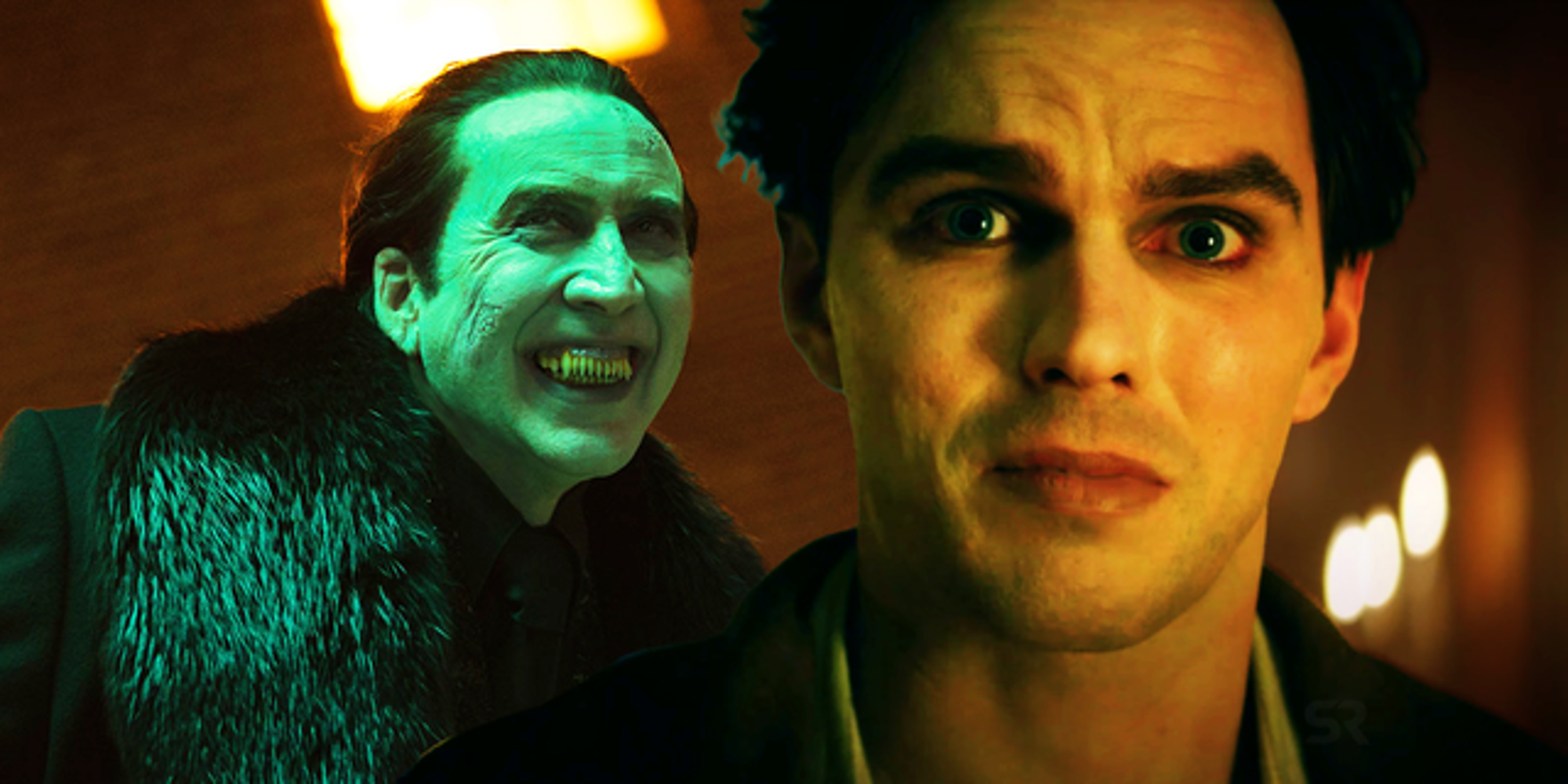

Renfield O astro Nicolas Cage fala sobre sua razão convincente para querer fazer um filme solo do Drácula. Parecia um elenco perfeito quando Cage foi anunciado como o homem para interpretar o mais famoso de todos os vampiros do cinema em um novo filme centrado no famoso lacaio de Drácula, Renfield. Essa sensação só foi reforçada quando o primeiro trailer de Renfield caiu, visualizando a visão única e maluca de Cage sobre o sugador de sangue imortal de Bram Stoker. Mas, como o próprio Cage revelou recentemente, seu Drácula desempenha apenas um pequeno papel no novo filme, cedendo os holofotes ao Renfield de Nicholas Hoult.

Aqueles desapontados com a notícia de que Cage limitou o tempo de tela em Renfield deve ter coragem, no entanto, já que o ator revelou seu desejo de fazer um filme solo de Drácula em algum lugar no futuro. Falando com Filme total (através da radar de jogos), Cage revelou por que exatamente ele quer explorar ainda mais sua Renfield personagem:

Você sabe, há alguns momentos menores aqui onde você consegue ver um pouco do pathos nos olhos do Drácula. Isso me fez pensar que talvez um dia eu queira tentar um filme inteiro onde você realmente entenda a psique do personagem. Eu realmente não tive tempo de me aprofundar nisso aqui.

Drácula é obrigado a ofuscar Renfield (apesar de seu tempo de tela limitado)

Renfield está sendo anunciado como uma comédia de terror que explora a divertida ideia de Renfield como um funcionário maltratado procurando se livrar do terrível chefe final depois de se apaixonar. O filme tem vários criativos célebres por trás das câmeras, incluindo O Filme Lego BatmanChris McKay como diretor e Rick e Morty ex-aluno Ryan Ridley escrevendo o roteiro de uma ideia de história Mortos-vivos criador Robert Kirkman. Com todas essas peças, há motivos para acreditar que o filme poderia conseguir o truque da comédia mineira de um personagem de terror secundário como Renfield.

Mas mesmo que o filme consiga tornar a situação de Renfield divertida, parece inevitável que o Drácula de Cage ofusque o personagem de Hoult, se não o filme inteiro. As conversas sobre o pré-lançamento do filme se concentraram principalmente em Cage, e quando o trailer foi lançado, o burburinho sobre a performance selvagem de Drácula de Cage só ficou mais alto. Os produtores com certeza sabiam que o elenco de Cage estava fadado a criar tanto burburinho, dada a forma como a internet fica obcecada com cada movimento seu.

Pode ser verdade que o Drácula de Cage aparece na tela apenas por breves momentos em Renfield, mas Cage não precisa de muito tempo na tela para dominar completamente um filme. Para o bem ou para o mal, Drácula já se sente o personagem principal de Renfield mesmo que ele não seja. Quando o filme for lançado, o público pode sentir que prefere assistir Cage explorar a psique de Drácula, em vez de rir de piadas sobre Renfield sendo o equivalente horroroso do assistente pessoal estressado de uma celebridade desajeitada.

Fonte: Total Film (via Games Radar)

Data de lançamento da chave

.