.

A visão da Nvidia para resfriamento de datacenter faz a pergunta: dada a escolha entre resfriamento líquido e de imersão, por que você deveria escolher?

Esse conceitoque envolve uma combinação de resfriamento líquido direto (DLC) para o silício e resfriamento por imersão para o restante dos componentes, é objeto de uma doação de US$ 5 milhões do Departamento de Energia dos EUA (DoE) sob sua programa COOLERCHIPS. O programa visa reduzir a quantidade de energia gasta no resfriamento do datacenter para menos de 5% da energia gasta na própria TI.

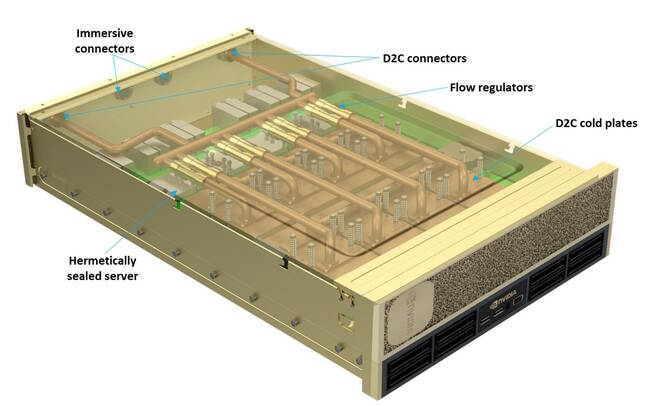

O conceito de resfriamento de servidor da Nvidia tem pouca semelhança com as configurações de resfriamento por imersão no estilo tanque que vimos em empresas como Submer ou LiquidStack. Ele mantém o fator de forma padrão de montagem em rack usado na maioria dos chassis refrigerados a ar e líquido direto.

À primeira vista, o conceito se parece muito com outro fornecedor de refrigeração por imersão: Iceotope. Nós olhamos para desenhos de iceotope de volta à Supercomputing 2022. A empresa oferece um chassi montado em rack no qual a placa-mãe de um dispositivo fica sob uma fina camada de refrigerante. O chassi bombeia refrigerante diretamente para a CPU, GPU, memória e até discos rígidos.

Essa abordagem tem algumas vantagens sobre os projetos tradicionais de resfriamento líquido direto. Um dos grandes é que elimina completamente a necessidade de ventiladores para resfriar componentes de baixa voltagem. Embora você possa liquidar CPUs e GPUs com bastante facilidade, memória, NICs e armazenamento são mais complicados. Submergir a placa-mãe em refrigerante elimina em grande parte a necessidade de ventoinhas.

O conceito de refrigeração líquida da Nvidia exige uma combinação de tecnologia de refrigeração líquida e de imersão – Clique para ampliar

O conceito da Nvidia exige refrigerantes de mudança de fase – semelhantes às substâncias usadas em geladeiras e condicionadores de ar – em vez dos fluidos monofásicos usados nos projetos da Iceotope. À medida que a placa-mãe esquenta, o líquido vai essencialmente ferver, condensar e pingar de volta. No entanto, o conceito da Nvidia também exige refrigeração líquida direta tradicional para as CPUs e GPUs.

Em teoria, isso deve permitir que a Nvidia atinja zonas de temperatura duplas: uma para componentes de alta potência de design térmico (TDP), como CPUs e GPUs, e outra para componentes mais frios, como memória ou placas de rede.

O interesse da Nvidia em refrigeração líquida não é surpreendente porque seus produtos produziram mais calor à medida que evoluíram. Hoje, as GPUs SXM da loja de chips chegam a 700W, enquanto seus superchips Grace-Hopper – que combinam um H100 com uma CPU Grace de 72 núcleos e 512 GB de LPDDR5 – são classificados para 1kW cada.

“Em breve, os sistemas refrigerados a ar de hoje não serão capazes de acompanhar. As atuais tecnologias refrigeradas a líquido não serão capazes de lidar com os mais de 40 watts por centímetro quadrado que os pesquisadores esperam que o futuro silício em datacenters precise se dissipar”, explica o post da Nvidia.

A Nvidia não é estranha ao resfriamento líquido. A gigante do acelerador oferece fatores de forma refrigerados a líquido para seus módulos de GPU SXM há alguns anos. No entanto, só recentemente introduzido resfriamento líquido para o resto de sua linha. Demorou até a conferência Computex em maio de 2022 para começar a oferecer suas populares placas PCIe A100 em um fator de forma DLC com planos para um H100 refrigerado a líquido a partir de 2023.

A Nvidia planeja entregar um sistema de teste combinando resfriamento líquido e de imersão em 2026 e prometeu atualizações sobre seu progresso em direção a esse objetivo o mais rápido possível.

De acordo com a postagem do blog, durante o primeiro ano, os engenheiros se concentrarão nos testes de componentes antes de passar para os testes parciais de rack em 2025. Para isso, a Nvidia contratou a empresa especializada em refrigeração líquida BOYD Corp para ajudar com placas frias; Durbin Group, campeão de resfriamento bifásico, para trabalhar em bombas; Honeywell para o refrigerante; e player de infraestrutura de datacenter Vertiv para rejeição de calor.

A Nvidia também trabalhará com as universidades de Binghamton e Villanova para análises, testes e análises e Sandia National Labs para avaliar a confiabilidade do conceito.

P&D de refrigeração líquida e por imersão decola

A Nvidia não é a única empresa que trabalha com tecnologia de resfriamento de datacenter. Intel recentemente progresso compartilhado em seus esforços para desenvolver uma variedade de sistemas capazes de dissipar quilowatts de calor de um único chip.

Muitos desses projetos se concentram em conceitos semelhantes – como submergir sistemas inteiros em tanques de fluidos dielétricos – mas também exploram o uso de fabricação avançada para incorporar câmaras de vapor 3D em “dissipadores de calor em forma de coral”. Pequenos jatos que disparam água fria sobre pontos quentes em chips são outra ideia.

Apesar do trabalho contínuo nessa área, os problemas financeiros da Intel levaram a alguns obstáculos, incluindo a cancelamento de um “mega-laboratório” de refrigeração líquida e imersão de US$ 700 milhões em Oregon. ®

.