.

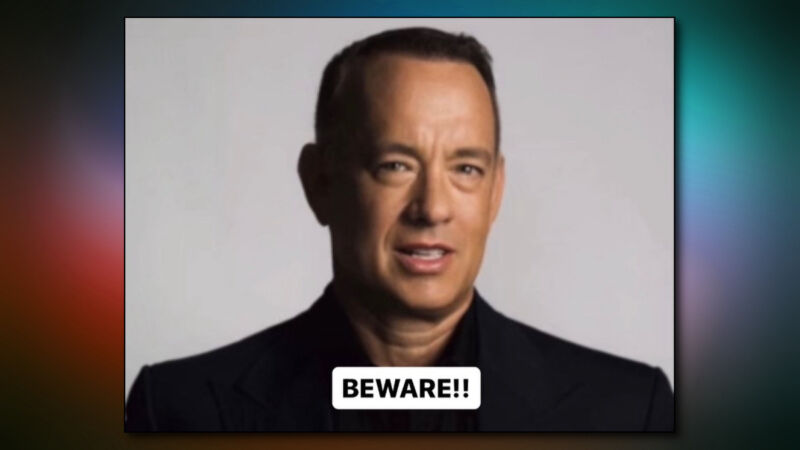

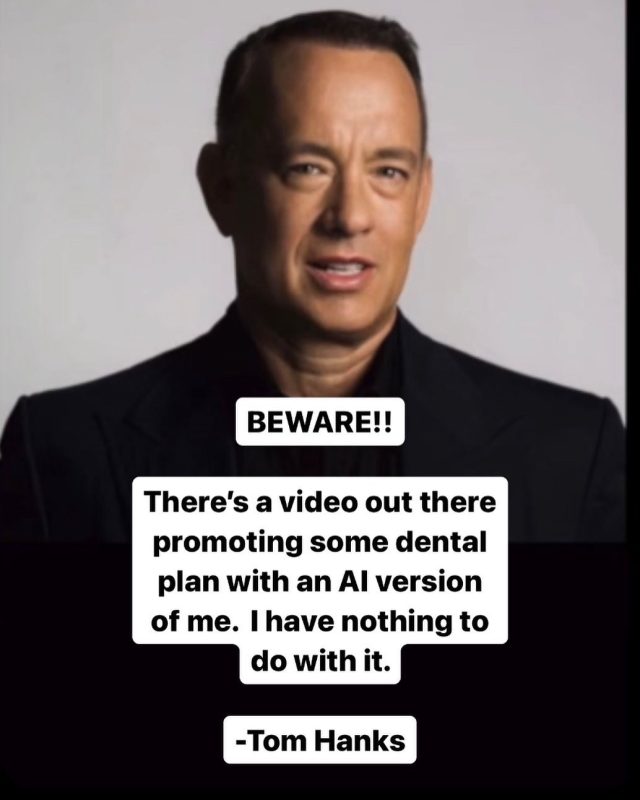

Tom Hanks

Notícias sobre deepfakes de IA se espalham rapidamente quando você é Tom Hanks. No domingo, o ator postou um aviso no Instagram sobre uma versão não autorizada de si mesmo gerada por IA sendo usada para vender um plano odontológico. O alerta de Hanks se espalhou pela mídia, incluindo o The New York Times. No dia seguinte, a âncora da CBS, Gayle King, alertou sobre um esquema semelhante usando sua imagem para vender um produto para perder peso. Os incidentes agora amplamente divulgados levantaram novas preocupações sobre o uso da IA nos meios digitais.

“CUIDADO!! Há um vídeo por aí promovendo um plano odontológico com uma versão minha de IA. Não tenho nada a ver com isso”, escreveu Hanks em seu feed do Instagram. Da mesma forma, King compartilhou um vídeo aumentado por IA com as palavras “Vídeo falso” estampadas, afirmando: “Nunca ouvi falar deste produto nem o usei!

Também na segunda-feira, a celebridade do YouTube MrBeast postou na rede de mídia social X sobre um golpe semelhante que apresenta um vídeo modificado dele com fala e movimentos labiais manipulados, promovendo uma oferta fraudulenta do iPhone 15. “Muitas pessoas estão recebendo esse anúncio fraudulento meu”, escreveu ele. “As plataformas de mídia social estão prontas para lidar com o aumento dos deepfakes de IA? Este é um problema sério.”

Tom Hanks/Instagram

Não vimos o vídeo original de Hanks, mas pelos exemplos fornecidos por King e MrBeast, parece que os golpistas provavelmente pegaram vídeos existentes das celebridades e usaram software para alterar os movimentos dos lábios para corresponder aos clones de voz deles gerados por IA que foram treinados em amostras vocais extraídas de trabalhos disponíveis publicamente.

A notícia surge em meio a um debate mais amplo sobre as implicações éticas e legais da IA na indústria de mídia e entretenimento. A recente greve do Writers Guild of America apresentou preocupações sobre a IA como um ponto significativo de discórdia. SAG-AFTRA, o sindicato que representa os atores de Hollywood, expressou preocupação de que a IA pudesse ser usada para criar réplicas digitais de atores sem a devida compensação ou aprovação. E recentemente, a filha de Robin Williams, Zelda Williams, virou notícia quando reclamou de pessoas clonando a voz de seu falecido pai sem permissão.

Como alertamos, convencer os deepfakes de IA é uma questão cada vez mais premente que pode minar a confiança partilhada e ameaçar a fiabilidade das tecnologias de comunicação, lançando dúvidas sobre a identidade de alguém. Lidar com isso é um problema complicado. Atualmente, empresas como Google e OpenAI têm planos de marcar conteúdo gerado por IA e adicionar metadados para rastrear a proveniência. Mas, historicamente, essas marcas d’água foram facilmente derrotadas e estão disponíveis ferramentas de IA de código aberto que não adicionam marcas d’água.

Uma captura de tela da postagem de Gayle King no Instagram alertando sobre um vídeo modificado por IA do âncora da CBS.

Gayle King/Instagram

Da mesma forma, as tentativas de restringir o software de IA através de regulamentação podem remover ferramentas de IA generativas de investigadores legítimos, mantendo-as nas mãos daqueles que as podem utilizar para fraudes. Enquanto isso, as redes sociais provavelmente precisarão intensificar os esforços de moderação, reagindo rapidamente quando conteúdo suspeito for sinalizado pelos usuários.

Como escrevemos em dezembro passado em um artigo sobre a disseminação de deepfakes fáceis de criar: “A procedência de cada foto que vemos se tornará muito mais importante; assim como hoje, precisaremos confiar completamente em quem está compartilhando as fotos com quem. acredite em qualquer um deles. Mas durante um período de transição antes que todos estejam cientes desta tecnologia, falsificações sintetizadas podem causar uma medida de caos.”

Quase um ano depois, com o rápido avanço da tecnologia, uma pequena amostra desse caos está indiscutivelmente caindo sobre nós, e nossos conselhos poderiam ser facilmente aplicados a vídeos e fotos. Se as tentativas de regulamentação actualmente em curso em muitos países terão algum efeito é uma questão em aberto.

.