.

Crédito: Google DeepMind de Pexels

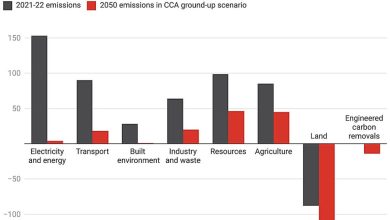

Sensores ambientais de custo cada vez mais baixo, juntamente com ferramentas analíticas alimentadas por IA, prometem um planejamento ambiental mais rápido e criterioso.

A necessidade de uma melhor tomada de decisão sobre a maneira como usamos os ecossistemas e os recursos naturais é ainda mais urgente agora porque as mudanças consentidas propostas no Projeto de Lei de Aprovações Aceleradas exigem avaliações mais rápidas.

Como parte de nossa pesquisa no Kuaha Matahiko, um projeto colaborativo e de acesso aberto para compilar dados sobre terra e água, descobrimos uma sede real de se envolver com IA entre os grupos iwi e hapū (tribais).

Organizações kaitiaki (guardiãs) ambientais sobrecarregadas viram a possibilidade da IA ajudar a integrar conjuntos de dados ambientais fragmentados e, ao mesmo tempo, melhorar a capacidade analítica de forma rápida e barata.

Com base nessa necessidade, o projeto Kuaha Matahiko desenvolveu uma IA funcional, treinada em dados ambientais da Aotearoa, Nova Zelândia. Isso mostra que um ponto de inflexão está surgindo, onde a IA sob medida está rapidamente se tornando uma opção realista para grupos kaitiaki, mesmo os pequenos.

No entanto, é preciso cuidado. Experiências anteriores mostram que sistemas movidos a algoritmos frequentemente nos prendem em caminhos que reproduzem desigualdades existentes na coleta de dados e impedem a imaginação sobre os resultados.

Esses problemas geralmente ocorrem devido a dois problemas interligados: um legado de coleta de dados ad hoc e uma crença muitas vezes equivocada de que maior volume de dados equivale a maior precisão.

A ‘armadilha de precisão’

Primeiro, sistemas de IA úteis exigem dados ricos em velocidade e volume. O Comissário Parlamentar para o Meio Ambiente alertou governos sucessivos de que o sistema de dados ambientais da Nova Zelândia é ad hoc, oportunista e com poucos recursos.

Os bancos de dados ambientais existentes refletem amplamente as prioridades da ciência agrícola liderada pelo estado e os esforços recentes para monitorar seus impactos ambientais. Nossos dados ambientais também sofrem de uma ignorância sistemática do mātauranga Māori.

Conjuntos de dados ambientais de longa duração são muito valiosos. Mas eles são muito incompletos em sua cobertura de lugares e problemas, e não podemos voltar no tempo para refazer a coleta de dados. Reconhecer as lacunas e vieses criados por um histórico de geração de dados desigual e excludente é crítico porque são esses dados (e as suposições incorporadas) que serão usados para treinar futuras IAs.

Segundo, a IA promete certeza e precisão. Mas um estudo que investiga agricultura de precisão descreve os riscos emergentes quando confundimos alto volume e granularidade de big data com alta precisão. Uma crença exagerada na precisão de big data pode levar a uma erosão de freios e contrapesos.

Isso se torna um problema cada vez maior à medida que a obscuridade dos algoritmos aumenta. A maioria dos algoritmos agora é ininteligível. Isso decorre da complexidade técnica, da incompreensão do usuário e das estratégias intencionais dos desenvolvedores. Isso nos cega para os riscos da imprecisão.

Ao não prestar atenção à opacidade dos algoritmos, corremos o risco de cair em uma “armadilha de precisão”. Isso ocorre quando a crença na precisão da IA se traduz em uma aceitação inquestionável da exatidão dos resultados da IA. Isso é um perigo por causa do valor político, social e legal que damos aos números como expressões confiáveis de “fatos concretos” objetivos.

Esses riscos aumentam rapidamente quando sistemas de IA são usados para prever (e governar) eventos futuros com base em modelos precisos, mas imprecisos, desvinculados de observações. Mas o que acontece quando as saídas de IA são a estrutura básica da avaliação e da tomada de decisão? Temos a opção de não acreditar nelas de forma alguma?

Evitando uma ‘gaiola de ferro’

Um futuro possível está no que o sociólogo alemão Max Weber chamou de “gaiola de ferro da racionalidade”. É onde as comunidades ficam presas em sistemas racionais, precisos e eficientes que são simultaneamente desumanos e injustos.

Evitar esse futuro significa criar proativamente parcerias de IA inclusivas, inteligíveis e diversas. Não se trata de rejeitar a racionalidade, mas de moderar seus resultados irracionais.

Nossa estrutura de governança de dados e IA em evolução se baseia nos princípios de ser localizável, acessível, interoperável e reutilizável (FAIR). Eles são muito úteis. Eles também são cegos para histórias sociais de coleta de dados.

O fracasso do Censo de 2018 é um exemplo claro do que acontece quando desigualdades históricas são ignoradas. Não podemos refazer os dados ambientais que temos. Mas novos sistemas de IA precisam ter consciência dos efeitos de lacunas de dados anteriores incorporadas em seu design. Também pode significar ir além da consciência para enriquecer ativamente os dados para abordar lacunas.

Ampliando a visão de mundo da IA

Dados e IA precisam servir objetivos humanos. Movimentos indígenas de soberania de dados estão reivindicando o direito dos povos indígenas de possuir e governar dados sobre suas comunidades, recursos e terras. Eles inspiraram estruturas conhecidas como CARE, que significa benefício coletivo, autoridade, responsabilidade e ética.

Elas oferecem um modelo de relações de dados empoderadoras que colocam relacionamentos humanos florescentes em primeiro lugar. Em Aotearoa, Nova Zelândia, a Te Kāhui Raraunga Māori foi estabelecida em 2019 como um órgão independente para permitir que os Māori acessem, coletem e usem seus próprios dados. Seu modelo de governança de dados é um exemplo desses princípios CARE em ação.

Um passo ainda maior seria expandir a visão de mundo da IA. Atender objetivos humanos significa expor as suposições e prioridades embutidas em diferentes IAs. Isso, por sua vez, significa abrir o desenvolvimento da IA além do que foi descrito como um ponto de vista “ESQUISITO” — ocidental, educado, industrial, rico, desenvolvido — que atualmente domina o campo.

Treinar uma IA em dados ambientais da Aotearoa Nova Zelândia para organizações Māori é uma coisa. É algo mais radical criar uma IA que incorpore o mātauranga Māori e as responsabilidades pela vida incorporadas na visão de mundo Māori.

Precisamos dessa visão radical da IA, deliberadamente construída a partir de diversas visões de mundo, para evitar trancar a gaiola e excluir o futuro.

Fornecido por The Conversation

Este artigo foi republicado do The Conversation sob uma licença Creative Commons. Leia o artigo original.![]()

Citação: A IA pode revolucionar o planejamento ambiental — se não ficarmos presos na “gaiola de ferro da racionalidade” (2024, 4 de julho) recuperado em 4 de julho de 2024 de https://phys.org/news/2024-07-ai-revolutionize-environmental-dont-iron.html

Este documento está sujeito a direitos autorais. Além de qualquer uso justo para fins de estudo ou pesquisa privada, nenhuma parte pode ser reproduzida sem permissão por escrito. O conteúdo é fornecido apenas para fins informativos.

.