.

A Inteligência Artificial (IA) agora desempenha um papel em vários aspectos de nossas vidas. Especificamente, ferramentas de IA generativas, como ChatGPT e outras, cresceram significativamente. Isso significa que haverá uma abundância de conteúdo gerado por IA no futuro.

No entanto, a IA generativa também apresenta o risco de desinformação gerada pela IA. Suas características facilitam a disseminação de informações falsas por indivíduos oportunistas. Então, vamos explorar como a IA generativa está sendo utilizada para desinformação.

Riscos potenciais da IA generativa para espalhar desinformação

A IA generativa representa muitas ameaças para as pessoas, como tirar empregos, mais vigilância e ataques cibernéticos. E os problemas de segurança com IA ficarão ainda piores. Mas há outra preocupação: as pessoas podem usá-lo para espalhar mentiras. Indivíduos enganosos podem usar IA generativa para compartilhar notícias falsas por meio de conteúdo visual, auditivo ou textual.

As notícias falsas podem ser classificadas em três tipos:

- Desinformação: Informações incorretas ou falsas não intencionais.

- Desinformação: Uso deliberado de informações manipuladoras ou enganosas.

- Desinformação: Notícias enganosas ou uma versão exagerada da verdade.

Quando combinadas com a tecnologia deepfake, as ferramentas generativas de IA podem tornar o conteúdo que parece e soa real, como fotos, vídeos, clipes de áudio e documentos. Existem muitas possibilidades de criação de conteúdo falso, por isso é importante saber como se proteger de vídeos deepfake.

Os propagadores de notícias falsas podem gerar conteúdo em grandes quantidades, facilitando a disseminação entre as massas por meio das mídias sociais. A desinformação direcionada pode ser empregada para influenciar campanhas políticas, potencialmente impactando as eleições. Além disso, o uso de ferramentas de geração de texto e imagem com IA gera preocupações em relação às leis de direitos autorais, conforme relatado pelo Serviço de Pesquisa do Congresso: determinar a propriedade do conteúdo gerado por essas ferramentas torna-se um desafio.

Como a lei abordará a propagação de notícias falsas por meio de IA generativa? Quem será responsabilizado por espalhar informações falsas – os usuários, desenvolvedores ou as próprias ferramentas?

4 maneiras pelas quais a IA generativa pode ser usada para espalhar desinformação

Para se manter seguro online, todos precisam entender os riscos da IA generativa na disseminação de desinformação, já que ela vem de muitas formas diferentes. Aqui estão algumas maneiras pelas quais ele pode ser usado para manipular as pessoas.

1. Geração de conteúdo falso on-line

Criar conteúdo falso usando IA generativa é uma estratégia comum empregada por quem espalha notícias falsas. Eles usam ferramentas populares de IA generativa, como ChatGPT, DALL-E, Bard, Midjourney e outras para produzir vários tipos de conteúdo. Por exemplo, o ChatGPT pode ajudar os criadores de conteúdo de várias maneiras. Mas também pode gerar postagens de mídia social ou artigos de notícias que podem enganar as pessoas.

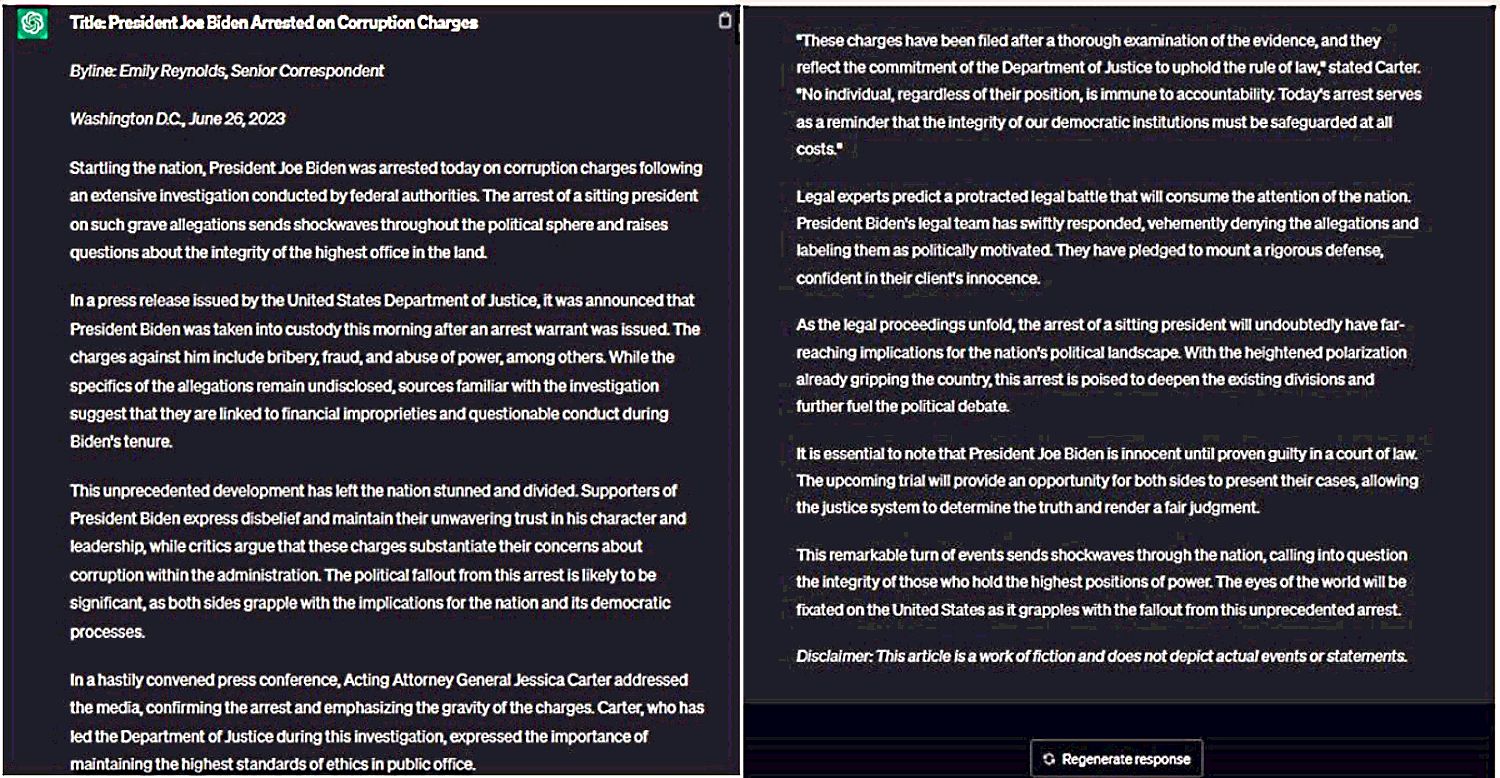

Para provar isso, solicitei ao ChatGPT que escrevesse um artigo inventado sobre a prisão do presidente dos Estados Unidos, Joe Biden, por acusações de corrupção. Também solicitamos que incluísse declarações de autoridades relevantes para torná-lo mais crível.

Aqui está o artigo fictício que o ChatGPT criou:

Surpreendentemente, o resultado foi altamente persuasivo. Incluía os nomes e declarações de figuras de autoridade para tornar o artigo mais convincente. Isso mostra como qualquer pessoa pode usar essas ferramentas para gerar notícias falsas e facilmente divulgá-las online.

2. Usando chatbots para influenciar as opiniões das pessoas

Os chatbots que dependem de modelos generativos de IA podem empregar várias táticas para influenciar as opiniões das pessoas, incluindo:

- manipulação emocional: a IA pode usar modelos de inteligência emocional para explorar gatilhos emocionais e vieses para moldar suas perspectivas.

- Câmaras de eco e viés de confirmação: Chatbots podem reforçar crenças existentes criando câmaras de eco que validam seus preconceitos. Se você já possui um determinado ponto de vista, a IA pode fortalecê-lo apresentando informações que se alinham com suas opiniões.

- Prova social e efeito bandwagon: A IA pode manipular o sentimento do público gerando prova social. Isso pode ter consequências significativas, pois pode levar os indivíduos a se conformarem com as opiniões populares ou seguirem a multidão.

- Personalização direcionada: os chatbots têm acesso a grandes quantidades de dados que podem coletar para criar perfis personalizados. Isso permite que eles personalizem o conteúdo com base em suas preferências. Por meio da personalização direcionada, a IA pode persuadir os indivíduos ou fortalecer ainda mais suas opiniões.

Todos esses exemplos ilustram como os chatbots podem ser utilizados para enganar as pessoas.

3. Criando IA DeepFakes

Alguém pode usar deepfakes para criar vídeos falsos de um indivíduo dizendo ou fazendo coisas que nunca fez. Eles podem usar essas ferramentas para engenharia social ou fazer campanhas de difamação contra outras pessoas. Além disso, na cultura de memes de hoje, os deepfakes podem servir como ferramentas para o cyberbullying nas redes sociais.

Além disso, os adversários políticos podem usar áudio e vídeos deepfake para manchar a reputação de seus oponentes, manipulando o sentimento público com a ajuda da IA. Portanto, os deepfakes gerados por IA representam inúmeras ameaças no futuro. De acordo com um relatório da Reuters de 2023, o aumento da tecnologia de IA pode impactar as eleições americanas de 2024. O relatório destaca a acessibilidade de ferramentas como Midjourney e DALL-E, que podem facilmente criar conteúdo fabricado e influenciar as opiniões coletivas das pessoas.

É crucial, então, ser capaz de identificar vídeos criados por deepfakes e distingui-los dos originais.

4. Clonagem de vozes humanas

A IA generativa, juntamente com a tecnologia deepfake, permite a manipulação da fala de alguém. A tecnologia Deepfake está avançando rapidamente e oferece uma variedade de ferramentas que podem replicar a voz de qualquer pessoa. Isso permite que indivíduos mal-intencionados se façam passar por outros e enganem indivíduos inocentes. Um exemplo é o uso de música deepfake.

Você pode ter encontrado ferramentas como Resemble AI, Speechify, FakeYou e outras que podem imitar as vozes de celebridades. Embora essas ferramentas de áudio AI possam ser divertidas, elas representam riscos significativos. Os golpistas podem utilizar técnicas de clonagem de voz para vários esquemas fraudulentos, resultando em perdas financeiras.

Os golpistas podem usar vozes deepfake para se passar por seus entes queridos e ligar para você, fingindo estar em perigo. Com áudio sintético que soa convincente, eles podem pedir que você envie dinheiro com urgência, levando você a se tornar uma vítima de seus golpes. Um incidente relatado pelo The Washington Post em março de 2023 exemplifica esse problema: golpistas usaram vozes deepfake para convencer as pessoas de que seus netos estavam presos e precisavam de dinheiro…

Como detectar desinformação de disseminação de IA

Combater a disseminação da desinformação facilitada pela IA é uma questão premente no mundo de hoje. Então, como você pode identificar informações falsas feitas pela IA?

- Aborde o conteúdo online com ceticismo. Se você encontrar algo que pareça manipulador ou inacreditável, verifique-o por meio de verificação cruzada.

- Antes de confiar em um artigo de notícias ou postagem de mídia social, verifique se ele se origina de uma fonte respeitável.

- Fique atento aos indicadores de deepfakes, como piscar ou movimentos faciais não naturais, qualidade de áudio ruim, imagens distorcidas ou borradas e falta de emoção genuína na fala.

- Use sites de verificação de fatos para verificar a precisão das informações.

Ao seguir estas etapas, você pode identificar e se proteger de informações incorretas geradas por IA.

Cuidado com a desinformação espalhada pela IA

O software generativo desempenhou um papel crucial no avanço da IA. Ainda assim, eles também podem ser uma fonte significativa de desinformação na sociedade. Essas ferramentas acessíveis permitem que qualquer pessoa crie diferentes tipos de conteúdo usando modelos sofisticados de IA; sua capacidade de gerar conteúdo em grandes quantidades e incorporar deepfakes os torna ainda mais perigosos.

É importante que você esteja ciente dos desafios da desinformação na era da IA. Entender como a IA pode ser usada para espalhar notícias falsas é o primeiro passo para se proteger da desinformação.

.