.

O rápido aumento da inteligência artificial (IA) não está apenas levantando preocupações entre as sociedades e legisladores, mas também alguns líderes tecnológicos no centro de seu desenvolvimento.

Alguns especialistas, incluindo o ‘padrinho da IA’ Geoffrey Hintonalertaram que a IA representa uma situação semelhante risco de extinção humana como pandemias e guerra nuclear.

Do chefe da empresa por trás do ChatGPT ao chefe do laboratório de IA do Google, mais de 350 pessoas disseram que mitigar o “risco de extinção da IA” deveria ser uma “prioridade global”.

Embora a IA possa executar tarefas que salvam vidas, como algoritmos que analisam imagens médicas como raios-X, varreduras e ultrassons, seus recursos de rápido crescimento e uso cada vez mais generalizado têm gerado preocupações.

Damos uma olhada em alguns dos principais – e por que os críticos dizem que alguns desses medos vão longe demais.

Desinformação e imagens alteradas por IA

Aplicativos de IA se tornaram virais em sites de mídia social, com usuários postando imagens falsas de celebridades e políticos, e estudantes usando ChatGPT e outros “modelos de aprendizado de idiomas” para gerar redações de nível universitário.

Um em geral A preocupação com a IA e seu desenvolvimento é a desinformação gerada pela IA e como ela pode causar confusão online.

O cientista britânico professor Stuart Russell disse que uma das maiores preocupações era a desinformação e os chamados deepfakes.

São vídeos ou fotos de uma pessoa em que seu rosto ou corpo foi alterado digitalmente para parecer outra pessoa – normalmente usados de forma maliciosa ou para espalhar informações falsas.

O professor Russell disse que, embora a desinformação exista há muito tempo para fins de “propaganda”, a diferença agora é que, usando Sophy Ridge como exemplo, ele poderia pedir ao chatbot online GPT-4, para tentar “manipulá-la” para que ela “menos favorável à Ucrânia”.

Na semana passada, uma imagem falsa que parecia mostrar uma explosão perto do Pentágono viralizou brevemente nas redes sociais e deixou os verificadores de fatos e o corpo de bombeiros local lutando para rebater a alegação.

Parecia que a imagem, que pretendia mostrar uma grande nuvem de fumaça preta ao lado da sede do Departamento de Defesa dos EUA, foi criada usando a tecnologia AI.

Foi postado pela primeira vez no Twitter e rapidamente recirculado por contas de notícias verificadas, mas falsas. Mas os verificadores de fatos logo provaram que não houve explosão no Pentágono.

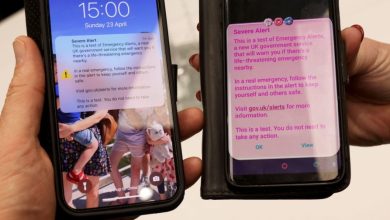

Mas algumas medidas estão sendo tomadas. Em novembro, o governo confirmou que o compartilhamento de “deepfakes” pornográficos sem consentimento será considerado crime sob a nova legislação.

Excedendo a inteligência humana

Os sistemas de IA envolvem a simulação de processos de inteligência humana por máquinas – mas existe o risco de que eles se desenvolvam a ponto de exceder o controle humano?

O professor Andrew Briggs, da Universidade de Oxford, disse à Strong The One que existe o medo de que, à medida que as máquinas se tornem mais poderosas, “chegue o dia” em que sua capacidade excederá a dos humanos.

Ele disse: “No momento, seja o que for que a máquina esteja programada para otimizar, é escolhido pelos humanos e pode ser escolhido para o mal ou para o bem. No momento, são os humanos que decidem.

“O medo é que, à medida que as máquinas se tornem cada vez mais inteligentes e poderosas, chegue o dia em que a capacidade exceda amplamente a dos humanos e os humanos percam a capacidade de manter o controle do que a máquina está tentando otimizar”.

Consulte Mais informação:

O que é GPT-4 e como é melhorado?

Ele disse que é por isso que é importante “prestar atenção” às possibilidades de danos e acrescentou que “não está claro para mim ou para qualquer um de nós que os governos realmente saibam como regular isso de maneira segura”.

Mas também há uma série de outras preocupações em torno da IA - incluindo seu impacto na educação, com especialistas levantando advertências sobre ensaios e empregos.

Apenas o último aviso

Entre os signatários da declaração do Center for AI Safety estavam Hinton e Yoshua Bengio – dois dos três chamados “padrinhos da IA” que receberam o Prêmio Turing de 2018 por seu trabalho em aprendizado profundo.

Mas o aviso de hoje não é a primeira vez que vimos especialistas em tecnologia levantarem preocupações sobre o desenvolvimento da IA.

Em março, Elon Musk e um grupo de especialistas em inteligência artificial pediu uma pausa no treinamento de poderosos sistemas de IA devido aos riscos potenciais para a sociedade e a humanidade.

A carta, emitida pelo Future of Life Institute sem fins lucrativos e assinada por mais de 1.000 pessoas, alertou sobre os riscos potenciais para a sociedade e a civilização por sistemas de IA competitivos entre humanos na forma de interrupções econômicas e políticas.

Ele pediu uma pausa de seis meses na “corrida perigosa” para desenvolver sistemas mais poderosos do que o recém-lançado GPT-4 da OpenAI.

No início desta semana, Rishi Sunak também se reuniu com o executivo-chefe do Google para discutir “encontrar o equilíbrio certo” entre regulamentação e inovação de IA. Downing Street disse que o primeiro-ministro conversou com Sundar Pichai sobre a importância de garantir que os “guardas-corpos” corretos estejam instalados para garantir a segurança tecnológica.

Os avisos são ‘besteiras’?

Embora alguns especialistas concordem com a declaração do Center for AI Safety, outros no campo rotularam a noção de “acabar com a civilização humana” como “besteira”.

Pedro Domingos, professor de ciência da computação e engenharia da Universidade de Washington, twittou: “Lembrete: a maioria dos pesquisadores de IA acha que a noção de IA acabar com a civilização humana é bobagem”.

Hinton respondeu, perguntando qual é o plano de Domingos para garantir que a IA “não nos manipule para dar-lhe o controle”.

O professor respondeu: “Você já está sendo manipulado todos os dias por pessoas que nem são tão inteligentes quanto você, mas de alguma forma você ainda está bem. Então, por que tanta preocupação com a IA em particular?”

.