.

O progresso da inteligência artificial (IA) tem sido implacável. Com o modelo mais recente da OpenAI, o3, recentemente quebrando recordes mais uma vez, levanta questões urgentes sobre a segurança, bem como sobre o futuro da humanidade.

Um lugar onde podemos pedir ajuda são os grandes pensadores do passado. Eles exploraram além do óbvio em seus mundos e muitas vezes olharam para o futuro, prevendo um tempo em que as máquinas teriam capacidades semelhantes às da IA.

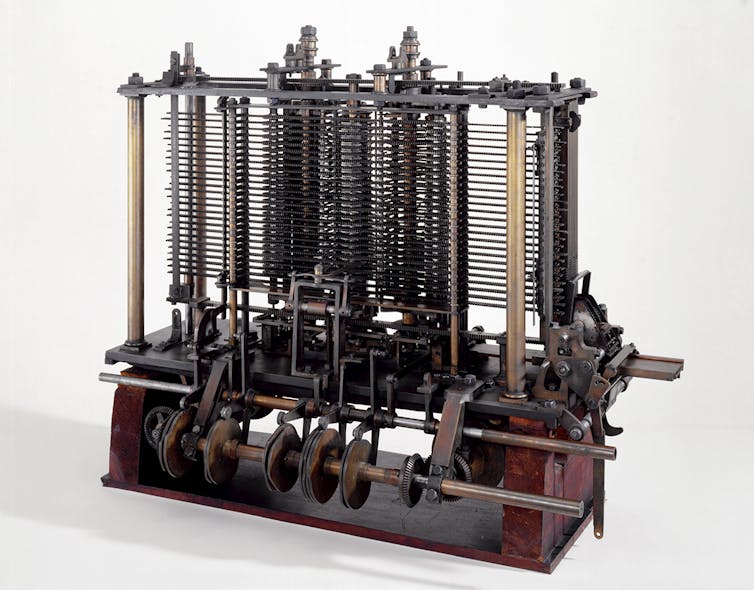

A matemática e escritora inglesa do século XIX, Ada Lovelace, é por vezes reconhecida como a primeira programadora de computador pelo seu trabalho com o polímata Charles Babbage no seu “motor analítico”. Este era um computador mecânico de uso geral, que nunca foi concluído, mas seu design refletia o dos computadores décadas depois.

Wikimedia, CC POR

Suas notas de 1842 para Babbage, explorando o potencial do dispositivo proposto, previram algo semelhante à IA no futuro. “Poderia atuar sobre outras coisas além do número”, disse ela, sugerindo que tal máquina poderia um dia expressar relações entre sons agudos, a fim de “compor peças musicais elaboradas e científicas de qualquer grau de complexidade ou extensão”.

Isso requer o reconhecimento de padrões em uma vasta gama de dados de som e música – exatamente o que grandes modelos de linguagem estão fazendo hoje ao gerar música a partir de prompts de texto.

Mesmo assim, Lovelace era cético em relação às capacidades de pensamento da máquina, argumentando que ela ainda dependeria dos humanos para originar tudo o que pudesse inventar. Na verdade, os modelos de IA de hoje ainda não estão realmente pensando, mas sim construindo sentenças baseadas em probabilidades matemáticas treinadas em trilhões de palavras humanas da Internet.

Lovelace apontou tais limitações para “precaver-se contra a possibilidade de ideias exageradas que possam surgir quanto aos poderes do motor analítico”. No entanto, ela também enfatizou as “influências colaterais” que esta máquina poderia ter além da sua produção pura. O seu exemplo é que poderia lançar uma nova luz sobre a ciência, mas a implicação mais ampla é que tais dispositivos nunca devem ser subestimados.

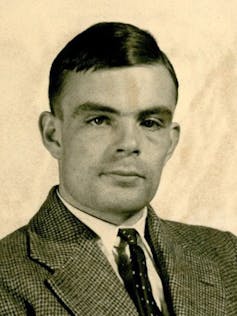

O teste de Turing

O argumento de Lovelace também levantou outra questão implícita. O que acontecerá se e quando as máquinas se tornarem as criadoras, quando a senciência não for mais ficção científica? Isto inspirou outro matemático e pensador inglês algumas décadas depois, Alan Turing.

O “jogo de imitação” de Turing de 1949, mais tarde conhecido como teste de Turing, procurou determinar se um computador poderia pensar de maneira comparável a um ser humano. Permaneceu como um teste importante de IA até ser considerado superado pelo ChatGPT da OpenAI em 2022.

Turing realmente pensou que isso aconteceria mais cedo, escrevendo em um famoso artigo de 1950:

Acredito que no final do século o uso das palavras e a opinião geral educada terão mudado tanto que será possível falar de máquinas pensando sem esperar ser contrariado.

Wikimedia, CC POR

Ele não estava especialmente pessimista sobre o que significaria cruzar esse Rubicão, argumentando no mesmo artigo a favor da tentativa de criar uma máquina que simulasse a mente de uma criança em vez da de um adulto. Ele pensou que isto poderia ser “facilmente programado”, o que implica que tínhamos pouco a temer de tais esforços.

Da mesma forma, ele não era cego ao potencial dos humanos acabarem subordinados por máquinas pensantes. Numa palestra pública em 1951, ele observou: “Se uma máquina pode pensar, poderá pensar de forma mais inteligente do que nós, e então onde deveríamos estar?”

O biógrafo de Turing, Christof Teuscher, descreveu-o como um “Orwell da ciência”. É interessante contrastar os seus pontos de vista com os do próprio George Orwell, que apesar de nunca ter ponderado sobre IA, falou sobre os perigos das máquinas de forma mais geral em The Road to Wigan Pier (1937).

Se você estiver preparado para trocar as referências a “máquinas” por “IA”, isso oferece possibilidades interessantes sobre o que Orwell poderia ter pensado da atual corrida armamentista tecnológica:

A hostilidade da pessoa sensível para com [AI] é, em certo sentido, irrealista, devido ao facto óbvio de que [AI] veio para ficar. Mas, como atitude mental, há muito a ser dito sobre isso…

Verbalmente, sem dúvida, concordaríamos que [AI] foi feito para o homem e não o homem para [AI]; na prática, qualquer tentativa de verificar o desenvolvimento de [AI] parece-nos um ataque ao conhecimento e, portanto, uma espécie de blasfémia. E mesmo que toda a humanidade subitamente se revoltasse contra [AI] e decidisse fugir para um modo de vida mais simples, a fuga ainda seria imensamente difícil…

Mecanize o mundo tão completamente quanto ele poderia ser mecanizado, e qualquer que seja o caminho que você tomar, haverá alguns [AI] impedindo-o de trabalhar – isto é, de viver.

A ética de Norbert Wiener

Granger – Arquivo de Imagens Históricas

Isto nos leva ao cientista e matemático americano Norbert Wiener. Reconhecido como o fundador da ética informática, o trabalho seminal de Wiener é The Human Use of Human Beings (1950), que tinha como objetivo “alertar contra os perigos” da exploração do potencial das máquinas.

Wiener previu um tempo em que as máquinas conversariam entre si e melhorariam com o tempo, sendo capazes de acompanhar seu desempenho anterior.

Comparando-o com o antigo conto popular de uma pessoa que encontra um djinnee (gênio) em uma garrafa e sabe que é melhor deixá-lo lá, ele escreveu:

A máquina, como o djinnee, que pode aprender e tomar decisões com base em seu aprendizado, não será de forma alguma obrigada a tomar as decisões que deveríamos ter tomado, ou que serão aceitáveis para nós.

Décadas mais tarde, o físico inglês Stephen Hawking teve preocupações semelhantes. Ele escreveu em 2016 que a IA poderia ser:

O maior acontecimento da história da nossa civilização, mas também poderá ser o último – a menos que aprendamos a evitar os riscos. Juntamente com os benefícios, a IA também trará perigos como poderosas armas autónomas ou novas formas para poucos oprimirem muitos.

Em seus últimos meses, ele escreveu:

Temo que a IA possa substituir completamente os humanos. Se as pessoas criam vírus de computador, alguém projetará uma IA que se melhore e se reproduza. Esta será uma nova forma de vida que superará os humanos.

Esses cinco gigantes do passado nos levam a pensar com muito cuidado sobre a IA. Lovelace falou sobre uma tendência humana de primeiro superestimar o potencial de uma nova tecnologia, apenas para depois corrigir exageradamente, subestimando a realidade. Wiener alertou contra a “exploração egoísta” do potencial tecnológico não testado, o que certamente nos levou a numerosos resultados catastróficos decorrentes de falhas de TI ao longo dos anos.

É evidente que a mesma coisa poderia acontecer agora com uma tecnologia muito mais poderosa. É provável que esses escritores tivessem olhado para os acontecimentos recentes e visto tolos correndo onde os anjos temem pisar.

.