.

Difusão estável / OpenAI

Na terça-feira, a OpenAI anunciou uma atualização considerável para suas grandes ofertas de API de modelo de linguagem (incluindo GPT-4 e gpt-3.5-turbo), incluindo um novo recurso de chamada de função, reduções significativas de custos e uma opção de janela de contexto de 16.000 tokens para o gpt- Modelo 3.5 turbo.

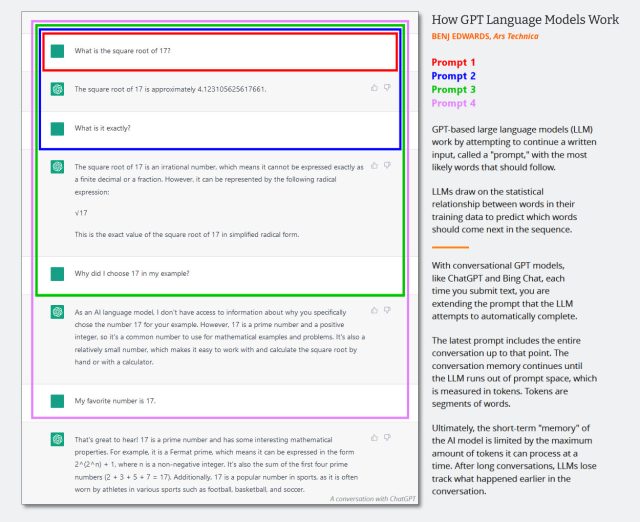

Em modelos de linguagem grandes (LLMs), a “janela de contexto” é como uma memória de curto prazo que armazena o conteúdo da entrada do prompt ou, no caso de um chatbot, todo o conteúdo da conversa em andamento. Em modelos de linguagem, aumentar o tamanho do contexto tornou-se uma corrida tecnológica, com a Anthropic anunciando recentemente uma opção de janela de contexto de 75.000 tokens para seu modelo de linguagem Claude. Além disso, a OpenAI desenvolveu uma versão de 32.000 tokens do GPT-4, mas ainda não está disponível ao público.

Nesse sentido, a OpenAI acaba de introduzir uma nova versão de janela de contexto de 16.000 gpt-3.5-turbo, chamada, sem surpresa, de “gpt-3.5-turbo-16k”, que permite que um prompt tenha até 16.000 tokens de comprimento. Com quatro vezes o comprimento de contexto da versão padrão de 4.000, o gpt-3.5-turbo-16k pode processar cerca de 20 páginas de texto em uma única solicitação. Este é um impulso considerável para os desenvolvedores que exigem que o modelo processe e gere respostas para grandes blocos de texto.

Conforme abordado em detalhes no post de anúncio, a OpenAI listou pelo menos quatro outras grandes mudanças em suas APIs GPT:

- Introdução do recurso de chamada de função na API de conclusões de bate-papo

- Versões melhoradas e “mais manobráveis” do GPT-4 e gpt-3.5-turbo

- Um corte de preço de 75% no modelo de incorporação “ada”

- Uma redução de preço de 25% nos tokens de entrada para gpt-3.5-turbo.

Com a chamada de funções, os desenvolvedores agora podem criar mais facilmente chatbots capazes de chamar ferramentas externas, converter linguagem natural em chamadas de API externas ou fazer consultas ao banco de dados. Por exemplo, ele pode converter prompts como “Envie um e-mail para Anya para ver se ela quer tomar café na próxima sexta-feira” em uma chamada de função como “send_email(to: string, body: string)”. Em particular, esse recurso também permitirá uma saída formatada em JSON consistente, que os usuários da API tinham dificuldade em gerar anteriormente.

Com relação à “direcionamento”, que é um termo sofisticado para o processo de fazer o LLM se comportar da maneira que você deseja, a OpenAI diz que seu novo modelo “gpt-3.5-turbo-0613” incluirá “direcionamento mais confiável por meio da mensagem do sistema .” A mensagem do sistema na API é um prompt de diretiva especial que informa ao modelo como se comportar, como “Você é uma careta. Você só fala sobre milkshakes”.

Além das melhorias funcionais, o OpenAI está oferecendo reduções de custos substanciais. Notavelmente, o preço dos tokens de entrada do popular gpt-3.5-turbo foi reduzido em 25%. Isso significa que os desenvolvedores agora podem usar esse modelo por aproximadamente US$ 0,0015 por 1.000 tokens de entrada e US$ 0,002 por 1.000 tokens de saída, o que equivale a cerca de 700 páginas por dólar. O modelo gpt-3.5-turbo-16k custa US$ 0,003 por 1.000 tokens de entrada e US$ 0,004 por 1.000 tokens de saída.

Benj Edwards / Strong The One

Além disso, a OpenAI está oferecendo uma enorme redução de custo de 75% para seu modelo de incorporação “text-embedding-ada-002”, que é mais esotérico em uso do que seus irmãos de conversação. Um modelo de incorporação é como um tradutor para computadores, transformando palavras e conceitos em uma linguagem numérica que as máquinas podem entender, o que é importante para tarefas como pesquisar texto e sugerir conteúdo relevante.

Como o OpenAI continua atualizando seus modelos, os antigos não existirão para sempre. Hoje, a empresa também anunciou que está iniciando o processo de descontinuação de algumas versões anteriores desses modelos, incluindo gpt-3.5-turbo-0301 e gpt-4-0314. A empresa diz que os desenvolvedores podem continuar usando esses modelos até 13 de setembro, após o qual os modelos mais antigos não estarão mais acessíveis.

Vale a pena notar que a API GPT-4 da OpenAI ainda está bloqueada em uma lista de espera e ainda está amplamente disponível.

.